书生·浦语大模型 实战营(第二期)-第四节 XTuner 微调个人小助手认知及多模态

一, XTuner 微调个人小助手认知章节

在本章中讲一步步带领大家体验如何利用 XTuner 完成个人小助手的微调!

1 开发机准备

首先我们需要前往 InternStudio 中创建一个开发机进行使用,这里跳过

2 快速上手

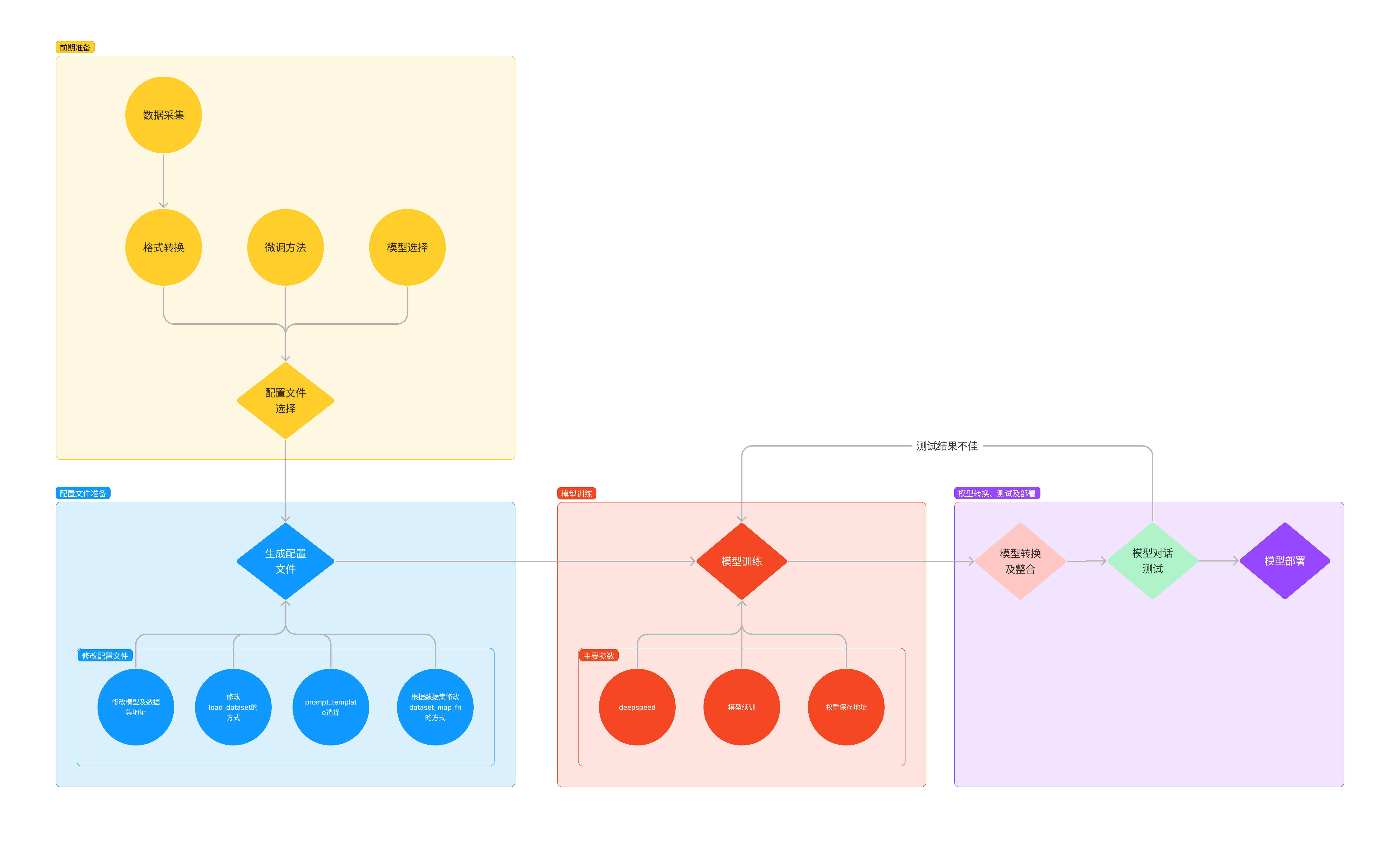

我们可以通过下面这张图来简单了解一下 XTuner 的运行原理。

1.环境安装:假如我们想要用 XTuner 这款简单易上手的微调工具包来对模型进行微调的话,那我们最最最先开始的第一步必然就是安装XTuner!安装基础的工具是一切的前提,只有安装了 XTuner 在我们本地后我们才能够去思考说具体怎么操作。

2.前期准备:那在完成了安装后,我们下一步就需要去明确我们自己的微调目标了。我们想要利用微调做一些什么事情呢,那我为了做到这个事情我有哪些硬件的资源和数据呢?假如我们有对于一件事情相关的数据集,并且我们还有足够的算力资源,那当然微调就是一件水到渠成的事情。就像 OpenAI 不就是如此吗?但是对于普通的开发者而言,在资源有限的情况下,我们可能就需要考虑怎么采集数据,用什么样的手段和方式来让模型有更好的效果。

3.启动微调:在确定了自己的微调目标后,我们就可以在 XTuner 的配置库中找到合适的配置文件并进行对应的修改。修改完成后即可一键启动训练!训练好的模型也可以仅仅通过在终端输入一行指令来完成转换和部署工作!

2.1 环境安装

首先我们需要先安装一个 XTuner 的源码到本地来方便后续的使用。

# 如果你是在 InternStudio 平台,则从本地 clone 一个已有 pytorch 的环境:

# pytorch 2.0.1 py3.10_cuda11.7_cudnn8.5.0_0

studio-conda xtuner0.1.17

# 如果你是在其他平台:

# conda create --name xtuner0.1.17 python=3.10 -y

# 激活环境

conda activate xtuner0.1.17

# 进入家目录 (~的意思是 “当前用户的home路径”)

cd ~

# 创建版本文件夹并进入,以跟随本教程

mkdir -p /root/xtuner0117 && cd /root/xtuner0117

# 拉取 0.1.17 的版本源码

git clone -b v0.1.17 https://github.com/InternLM/xtuner

# 无法访问github的用户请从 gitee 拉取:

# git clone -b v0.1.15 https://gitee.com/Internlm/xtuner

# 进入源码目录

cd /root/xtuner0117/xtuner

# 从源码安装 XTuner

pip install -e '.[all]'假如速度太慢可以

Ctrl + C退出后换成pip install -e '.[all]' -i https://mirrors.aliyun.com/pypi/simple/

假如在这一过程中没有出现任何的报错的话,那也就意味着我们成功安装好支持 XTuner 所运行的环境啦。其实对于很多的初学者而言,安装好环境意味着成功了一大半!因此我们接下来就可以进入我们的第二步,准备好我们需要的数据集、模型和配置文件!

2.2 前期准备

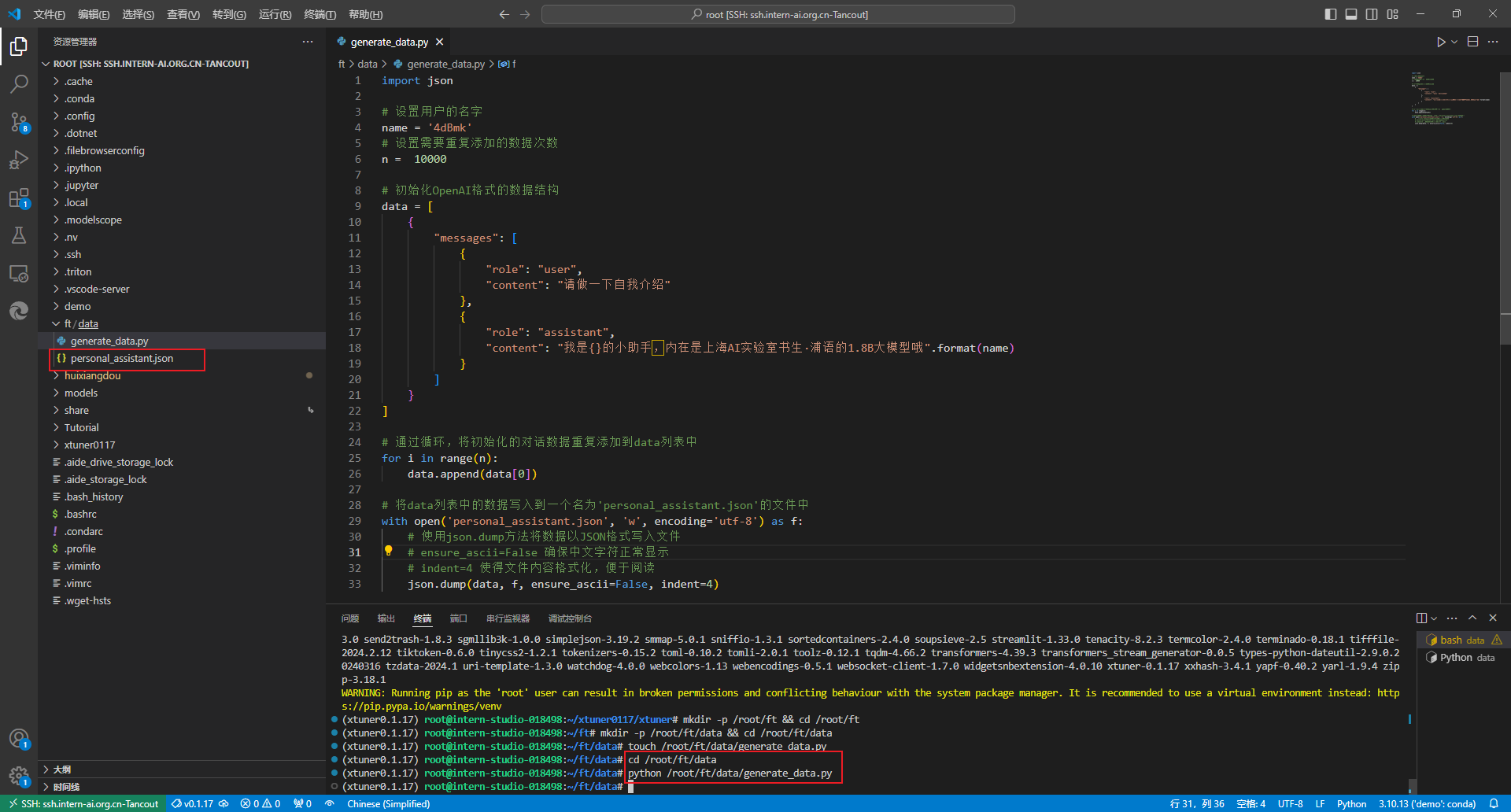

2.2.1 数据集准备

为了让模型能够让模型认清自己的身份弟位,知道在询问自己是谁的时候回复成我们想要的样子,我们就需要通过在微调数据集中大量掺杂这部分的数据。

首先我们先创建一个文件夹来存放我们这次训练所需要的所有文件。

# 前半部分是创建一个文件夹,后半部分是进入该文件夹。

mkdir -p /root/ft && cd /root/ft

# 在ft这个文件夹里再创建一个存放数据的data文件夹

mkdir -p /root/ft/data && cd /root/ft/data打开该 python 文件后将下面的内容复制进去。

import json

# 设置用户的名字

name = '4dBmk'

# 设置需要重复添加的数据次数

n = 10000

# 初始化OpenAI格式的数据结构

data = [

{

"messages": [

{

"role": "user",

"content": "请做一下自我介绍"

},

{

"role": "assistant",

"content": "我是{}的小助手,内在是上海AI实验室书生·浦语的1.8B大模型哦".format(name)

}

]

}

]

# 通过循环,将初始化的对话数据重复添加到data列表中

for i in range(n):

data.append(data[0])

# 将data列表中的数据写入到一个名为'personal_assistant.json'的文件中

with open('personal_assistant.json', 'w', encoding='utf-8') as f:

# 使用json.dump方法将数据以JSON格式写入文件

# ensure_ascii=False 确保中文字符正常显示

# indent=4 使得文件内容格式化,便于阅读

json.dump(data, f, ensure_ascii=False, indent=4)并将文件 name 后面的内容修改为你的名称。

修改完成后运行 generate_data.py 文件即可。

# 确保先进入该文件夹

cd /root/ft/data

# 运行代码

python /root/ft/data/generate_data.py

可以看到在data的路径下便生成了一个名为 personal_assistant.json 的文件,这样我们最可用于微调的数据集就准备好啦!里面就包含了 5000 条 input 和 output 的数据对。假如 我们认为 5000 条不够的话也可以调整文件中第6行 n 的值哦!

|-- data/

|-- personal_assistant.json

|-- generate_data.py除了我们自己通过脚本的数据集,其实网上也有大量的开源数据集可以供我们进行使用。有些时候我们可以在开源数据集的基础上添加一些我们自己独有的数据集,也可能会有很好的效果。

2.2.2 模型准备

在准备好了数据集后,接下来我们就需要准备好我们的要用于微调的模型。由于本次课程显存方面的限制,这里我们就使用 InternLM 最新推出的小模型 InterLM2-Chat-1.8B 来完成此次的微调演示。

对于在 InternStudio 上运行的小伙伴们,可以不用通过 OpenXLab 或者 Modelscope 进行模型的下载。我们直接通过以下代码一键创建文件夹并将所有文件复制进去。(这里我为了节省硬盘空间,选择软连接方式挂载)

# 软链接到模型地址

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b/ /root/ft/model/那这个时候我们就可以看到在 model 文件夹下保存了模型的相关文件和内容了。

|-- model/

|-- internlm2-chat-1_8b/

|-- tokenizer.model

|-- config.json

|-- .mdl

|-- tokenization_internlm2.py

|-- model-00002-of-00002.safetensors

|-- tokenizer_config.json

|-- model-00001-of-00002.safetensors

|-- model.safetensors.index.json

|-- configuration.json

|-- .msc

|-- special_tokens_map.json

|-- .mv

|-- modeling_internlm2.py

|-- README.md

|-- configuration_internlm2.py

|-- generation_config.json

|-- tokenization_internlm2_fast.py2.2.3 配置文件选择

在准备好了模型和数据集后,我们就要根据我们选择的微调方法方法结合前面的信息来找到与我们最匹配的配置文件了,从而减少我们对配置文件的修改量。

所谓配置文件(config),其实是一种用于定义和控制模型训练和测试过程中各个方面的参数和设置的工具。准备好的配置文件只要运行起来就代表着模型就开始训练或者微调了。

XTuner 提供多个开箱即用的配置文件,用户可以通过下列命令查看:

开箱即用意味着假如能够连接上 Huggingface 以及有足够的显存,其实就可以直接运行这些配置文件,XTuner就能够直接下载好这些模型和数据集然后开始进行微调

# 列出所有内置配置文件

# xtuner list-cfg

# 假如我们想找到 internlm2-1.8b 模型里支持的配置文件

xtuner list-cfg -p internlm2_1_8b这里就用到了第一个 XTuner 的工具

list-cfg,对于这个工具而言,可以选择不添加额外的参数,就像上面的一样,这样就会将所有的配置文件都打印出来。那同时也可以加上一个参数-p或--pattern,后面输入的内容将会在所有的 config 文件里进行模糊匹配搜索,然后返回最有可能得内容。我们可以用来搜索特定模型的配置文件,比如例子中的 internlm2_1_8b ,也可以用来搜索像是微调方法 qlora 。 根据上面的定向搜索指令可以看到目前只有两个支持 internlm2-1.8B 的模型配置文件。

==========================CONFIGS===========================

PATTERN: internlm2_1_8b

-------------------------------

internlm2_1_8b_full_alpaca_e3

internlm2_1_8b_qlora_alpaca_e3

=============================================================配置文件名的解释

以 internlm2_1_8b_qlora_alpaca_e3 举例:

| 模型名 | 说明 |

|---|---|

| internlm2_1_8b | 模型名称 |

| qlora | 使用的算法 |

| alpaca | 数据集名称 |

| e3 | 把数据集跑3次 |

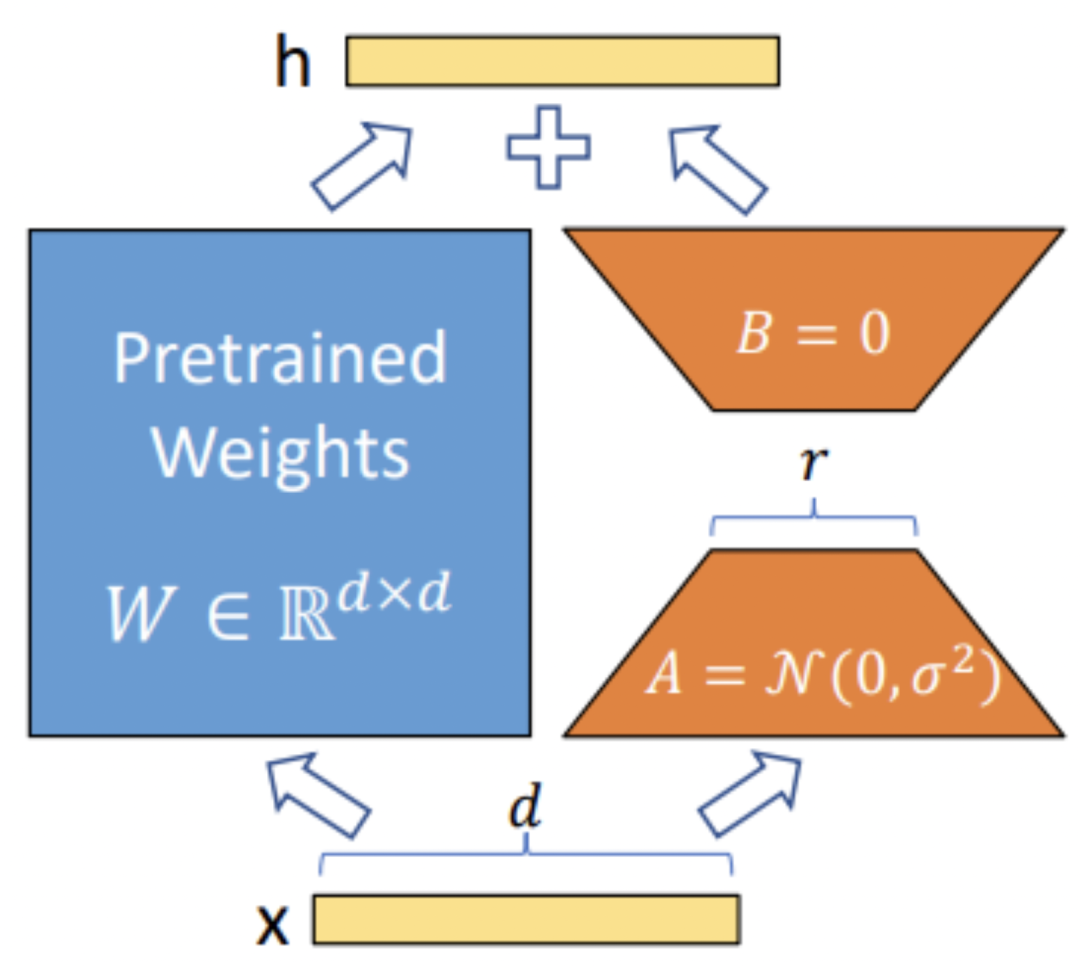

QLORA是一种针对深度神经网络的低精度量化和微调技术,能够实现高保真的4位微调。「它采用了两种技术——4位NormalFloat (NF4)量化和Double Quantization」。将内存使用降低到足以「在单个48GB GPU上微调650亿参数模型」

虽然我们用的数据集并不是 alpaca 而是我们自己通过脚本制作的小助手数据集 ,但是由于我们是通过 QLoRA 的方式对 internlm2-chat-1.8b 进行微调。而最相近的配置文件应该就是 internlm2_1_8b_qlora_alpaca_e3 ,因此我们可以选择拷贝这个配置文件到当前目录:

# 创建一个存放 config 文件的文件夹

mkdir -p /root/ft/config

# 使用 XTuner 中的 copy-cfg 功能将 config 文件复制到指定的位置

xtuner copy-cfg internlm2_1_8b_qlora_alpaca_e3 /root/ft/config这里我们就用到了 XTuner 工具箱中的第二个工具

copy-cfg,该工具有两个必须要填写的参数{CONFIG_NAME}和{SAVE_PATH},在我们的输入的这个指令中,我们的{CONFIG_NAME}对应的是上面搜索到的internlm2_1_8b_qlora_alpaca_e3,而{SAVE_PATH}则对应的是刚刚新建的/root/ft/config。我们假如需要复制其他的配置文件只需要修改这两个参数即可实现。 输入后我们就能够看到在我们的/root/ft/config文件夹下有一个名为internlm2_1_8b_qlora_alpaca_e3_copy.py的文件了。

# 创建一个存放 config 文件的文件夹

mkdir -p /root/ft/config

# 使用 XTuner 中的 copy-cfg 功能将 config 文件复制到指定的位置

xtuner copy-cfg internlm2_1_8b_qlora_alpaca_e3 /root/ft/config配置文件介绍

假如我们真的打开配置文件后,我们可以看到整体的配置文件分为五部分:

-

PART 1 Settings:涵盖了模型基本设置,如预训练模型的选择、数据集信息和训练过程中的一些基本参数(如批大小、学习率等)。

-

PART 2 Model & Tokenizer:指定了用于训练的模型和分词器的具体类型及其配置,包括预训练模型的路径和是否启用特定功能(如可变长度注意力),这是模型训练的核心组成部分。

-

PART 3 Dataset & Dataloader:描述了数据处理的细节,包括如何加载数据集、预处理步骤、批处理大小等,确保了模型能够接收到正确格式和质量的数据。

-

PART 4 Scheduler & Optimizer:配置了优化过程中的关键参数,如学习率调度策略和优化器的选择,这些是影响模型训练效果和速度的重要因素。

-

PART 5 Runtime:定义了训练过程中的额外设置,如日志记录、模型保存策略和自定义钩子等,以支持训练流程的监控、调试和结果的保存。

一般来说我们需要更改的部分其实只包括前三部分,而且修改的主要原因是我们修改了配置文件中规定的模型、数据集。后两部分都是 XTuner 官方帮我们优化好的东西,一般而言只有在魔改的情况下才需要进行修改。下面我们将根据项目的要求一步步的进行修改和调整吧!

通过折叠部分的修改,内容如下,可以直接将以下代码复制到 /root/ft/config/internlm2_1_8b_qlora_alpaca_e3_copy.py 文件中(先 Ctrl + A 选中所有文件并删除后再将代码复制进去)。

参数修改细节

首先在 PART 1 的部分,由于我们不再需要在 Huggingface 上自动下载模型,因此我们先要更换模型的路径以及数据集的路径为我们本地的路径。

# 修改模型地址(在第27行的位置)

- pretrained_model_name_or_path = 'internlm/internlm2-1_8b'

+ pretrained_model_name_or_path = '/root/ft/model/internlm2-chat-1_8b'

# 修改数据集地址为本地的json文件地址(在第31行的位置)

- alpaca_en_path = 'tatsu-lab/alpaca'

+ alpaca_en_path = '/root/ft/data/personal_assistant.json'除此之外,我们还可以对一些重要的参数进行调整,包括学习率(lr)、训练的轮数(max_epochs)等等。由于我们这次只是一个简单的让模型知道自己的身份弟位,因此我们的训练轮数以及单条数据最大的 Token 数(max_length)都可以不用那么大。

# 修改max_length来降低显存的消耗(在第33行的位置)

- max_length = 2048

+ max_length = 1024

# 减少训练的轮数(在第44行的位置)

- max_epochs = 3

+ max_epochs = 2

# 增加保存权重文件的总数(在第54行的位置)

- save_total_limit = 2

+ save_total_limit = 3另外,为了训练过程中能够实时观察到模型的变化情况,XTuner 也是贴心的推出了一个 evaluation_inputs 的参数来让我们能够设置多个问题来确保模型在训练过程中的变化是朝着我们想要的方向前进的。比如说我们这里是希望在问出 “请你介绍一下你自己” 或者说 “你是谁” 的时候,模型能够给你的回复是 “我是XXX的小助手...” 这样的回复。因此我们也可以根据这个需求进行更改。

# 修改每多少轮进行一次评估(在第57行的位置)

- evaluation_freq = 500

+ evaluation_freq = 300

# 修改具体评估的问题(在第59到61行的位置)

# 可以自由拓展其他问题

- evaluation_inputs = ['请给我介绍五个上海的景点', 'Please tell me five scenic spots in Shanghai']

+ evaluation_inputs = ['请你介绍一下你自己', '你是谁', '你是我的小助手吗']这样修改完后在评估过程中就会显示在当前的权重文件下模型对这几个问题的回复了。

由于我们的数据集不再是原本的 aplaca 数据集,因此我们也要进入 PART 3 的部分对相关的内容进行修改。包括说我们数据集输入的不是一个文件夹而是一个单纯的 json 文件以及我们的数据集格式要求改为我们最通用的 OpenAI 数据集格式。

# 把 OpenAI 格式的 map_fn 载入进来(在第15行的位置)

- from xtuner.dataset.map_fns import alpaca_map_fn, template_map_fn_factory

+ from xtuner.dataset.map_fns import openai_map_fn, template_map_fn_factory

# 将原本是 alpaca 的地址改为是 json 文件的地址(在第102行的位置)

- dataset=dict(type=load_dataset, path=alpaca_en_path),

+ dataset=dict(type=load_dataset, path='json', data_files=dict(train=alpaca_en_path)),

# 将 dataset_map_fn 改为通用的 OpenAI 数据集格式(在第105行的位置)

- dataset_map_fn=alpaca_map_fn,

+ dataset_map_fn=openai_map_fn,常用参数介绍

常用超参

| 参数名 | 解释 |

|---|---|

| data_path | 数据路径或 HuggingFace 仓库名 |

| max_length | 单条数据最大 Token 数,超过则截断 |

| pack_to_max_length | 是否将多条短数据拼接到 max_length,提高 GPU 利用率 |

| accumulative_counts | 梯度累积,每多少次 backward 更新一次参数 |

| sequence_parallel_size | 并行序列处理的大小,用于模型训练时的序列并行 |

| batch_size | 每个设备上的批量大小 |

| dataloader_num_workers | 数据加载器中工作进程的数量 |

| max_epochs | 训练的最大轮数 |

| optim_type | 优化器类型,例如 AdamW |

| lr | 学习率 |

| betas | 优化器中的 beta 参数,控制动量和平方梯度的移动平均 |

| weight_decay | 权重衰减系数,用于正则化和避免过拟合 |

| max_norm | 梯度裁剪的最大范数,用于防止梯度爆炸 |

| warmup_ratio | 预热的比例,学习率在这个比例的训练过程中线性增加到初始学习率 |

| save_steps | 保存模型的步数间隔 |

| save_total_limit | 保存的模型总数限制,超过限制时删除旧的模型文件 |

| prompt_template | 模板提示,用于定义生成文本的格式或结构 |

| ...... | ...... |

如果想把显卡的现存吃满,充分利用显卡资源,可以将

max_length和batch_size这两个参数调大。

# Copyright (c) OpenMMLab. All rights reserved.

import torch

from datasets import load_dataset

from mmengine.dataset import DefaultSampler

from mmengine.hooks import (CheckpointHook, DistSamplerSeedHook, IterTimerHook,

LoggerHook, ParamSchedulerHook)

from mmengine.optim import AmpOptimWrapper, CosineAnnealingLR, LinearLR

from peft import LoraConfig

from torch.optim import AdamW

from transformers import (AutoModelForCausalLM, AutoTokenizer,

BitsAndBytesConfig)

from xtuner.dataset import process_hf_dataset

from xtuner.dataset.collate_fns import default_collate_fn

from xtuner.dataset.map_fns import openai_map_fn, template_map_fn_factory

from xtuner.engine.hooks import (DatasetInfoHook, EvaluateChatHook,

VarlenAttnArgsToMessageHubHook)

from xtuner.engine.runner import TrainLoop

from xtuner.model import SupervisedFinetune

from xtuner.parallel.sequence import SequenceParallelSampler

from xtuner.utils import PROMPT_TEMPLATE, SYSTEM_TEMPLATE

#######################################################################

# PART 1 Settings #

#######################################################################

# Model

pretrained_model_name_or_path = '/root/ft/model/internlm2-chat-1_8b'

use_varlen_attn = False

# Data

alpaca_en_path = '/root/ft/data/personal_assistant.json'

prompt_template = PROMPT_TEMPLATE.default

max_length = 1024

pack_to_max_length = True

# parallel

sequence_parallel_size = 1

# Scheduler & Optimizer

batch_size = 1 # per_device

accumulative_counts = 16

accumulative_counts *= sequence_parallel_size

dataloader_num_workers = 0

max_epochs = 2

optim_type = AdamW

lr = 2e-4

betas = (0.9, 0.999)

weight_decay = 0

max_norm = 1 # grad clip

warmup_ratio = 0.03

# Save

save_steps = 500

save_total_limit = 3 # Maximum checkpoints to keep (-1 means unlimited)

# Evaluate the generation performance during the training

evaluation_freq = 300

SYSTEM = SYSTEM_TEMPLATE.alpaca

evaluation_inputs = ['请你介绍一下你自己', '你是谁', '你是我的小助手吗']

#######################################################################

# PART 2 Model & Tokenizer #

#######################################################################

tokenizer = dict(

type=AutoTokenizer.from_pretrained,

pretrained_model_name_or_path=pretrained_model_name_or_path,

trust_remote_code=True,

padding_side='right')

model = dict(

type=SupervisedFinetune,

use_varlen_attn=use_varlen_attn,

llm=dict(

type=AutoModelForCausalLM.from_pretrained,

pretrained_model_name_or_path=pretrained_model_name_or_path,

trust_remote_code=True,

torch_dtype=torch.float16,

quantization_config=dict(

type=BitsAndBytesConfig,

load_in_4bit=True,

load_in_8bit=False,

llm_int8_threshold=6.0,

llm_int8_has_fp16_weight=False,

bnb_4bit_compute_dtype=torch.float16,

bnb_4bit_use_double_quant=True,

bnb_4bit_quant_type='nf4')),

lora=dict(

type=LoraConfig,

r=64,

lora_alpha=16,

lora_dropout=0.1,

bias='none',

task_type='CAUSAL_LM'))

#######################################################################

# PART 3 Dataset & Dataloader #

#######################################################################

alpaca_en = dict(

type=process_hf_dataset,

dataset=dict(type=load_dataset, path='json', data_files=dict(train=alpaca_en_path)),

tokenizer=tokenizer,

max_length=max_length,

dataset_map_fn=openai_map_fn,

template_map_fn=dict(

type=template_map_fn_factory, template=prompt_template),

remove_unused_columns=True,

shuffle_before_pack=True,

pack_to_max_length=pack_to_max_length,

use_varlen_attn=use_varlen_attn)

sampler = SequenceParallelSampler \

if sequence_parallel_size > 1 else DefaultSampler

train_dataloader = dict(

batch_size=batch_size,

num_workers=dataloader_num_workers,

dataset=alpaca_en,

sampler=dict(type=sampler, shuffle=True),

collate_fn=dict(type=default_collate_fn, use_varlen_attn=use_varlen_attn))

#######################################################################

# PART 4 Scheduler & Optimizer #

#######################################################################

# optimizer

optim_wrapper = dict(

type=AmpOptimWrapper,

optimizer=dict(

type=optim_type, lr=lr, betas=betas, weight_decay=weight_decay),

clip_grad=dict(max_norm=max_norm, error_if_nonfinite=False),

accumulative_counts=accumulative_counts,

loss_scale='dynamic',

dtype='float16')

# learning policy

# More information: https://github.com/open-mmlab/mmengine/blob/main/docs/en/tutorials/param_scheduler.md # noqa: E501

param_scheduler = [

dict(

type=LinearLR,

start_factor=1e-5,

by_epoch=True,

begin=0,

end=warmup_ratio * max_epochs,

convert_to_iter_based=True),

dict(

type=CosineAnnealingLR,

eta_min=0.0,

by_epoch=True,

begin=warmup_ratio * max_epochs,

end=max_epochs,

convert_to_iter_based=True)

]

# train, val, test setting

train_cfg = dict(type=TrainLoop, max_epochs=max_epochs)

#######################################################################

# PART 5 Runtime #

#######################################################################

# Log the dialogue periodically during the training process, optional

custom_hooks = [

dict(type=DatasetInfoHook, tokenizer=tokenizer),

dict(

type=EvaluateChatHook,

tokenizer=tokenizer,

every_n_iters=evaluation_freq,

evaluation_inputs=evaluation_inputs,

system=SYSTEM,

prompt_template=prompt_template)

]

if use_varlen_attn:

custom_hooks += [dict(type=VarlenAttnArgsToMessageHubHook)]

# configure default hooks

default_hooks = dict(

# record the time of every iteration.

timer=dict(type=IterTimerHook),

# print log every 10 iterations.

logger=dict(type=LoggerHook, log_metric_by_epoch=False, interval=10),

# enable the parameter scheduler.

param_scheduler=dict(type=ParamSchedulerHook),

# save checkpoint per `save_steps`.

checkpoint=dict(

type=CheckpointHook,

by_epoch=False,

interval=save_steps,

max_keep_ckpts=save_total_limit),

# set sampler seed in distributed evrionment.

sampler_seed=dict(type=DistSamplerSeedHook),

)

# configure environment

env_cfg = dict(

# whether to enable cudnn benchmark

cudnn_benchmark=False,

# set multi process parameters

mp_cfg=dict(mp_start_method='fork', opencv_num_threads=0),

# set distributed parameters

dist_cfg=dict(backend='nccl'),

)

# set visualizer

visualizer = None

# set log level

log_level = 'INFO'

# load from which checkpoint

load_from = None

# whether to resume training from the loaded checkpoint

resume = False

# Defaults to use random seed and disable `deterministic`

randomness = dict(seed=None, deterministic=False)

# set log processor

log_processor = dict(by_epoch=False)

2.4 模型训练

2.4.1 常规训练

当我们准备好了配置文件好,我们只需要将使用 xtuner train 指令即可开始训练。

我们可以通过添加 --work-dir 指定特定的文件保存位置,比如说就保存在 /root/ft/train 路径下。假如不添加的话模型训练的过程文件将默认保存在 ./work_dirs/internlm2_1_8b_qlora_alpaca_e3_copy 的位置,就比如说我是在 /root/ft/train 的路径下输入该指令,那么我的文件保存的位置就是在 /root/ft/train/work_dirs/internlm2_1_8b_qlora_alpaca_e3_copy 的位置下。

# 指定保存路径

xtuner train /root/ft/config/internlm2_1_8b_qlora_alpaca_e3_copy.py --work-dir /root/ft/train在输入训练完后的文件如下所示:

|-- train/

|-- internlm2_1_8b_qlora_alpaca_e3_copy.py

|-- last_checkpoint

|-- iter_768.pth

|-- iter_500.pth

|-- 20240416_132417/

|-- 20240416_132417.log

|-- vis_data/

|-- 20240416_132417.json

|-- eval_outputs_iter_767.txt

|-- scalars.json

|-- config.py

|-- eval_outputs_iter_499.txt2.4.2 使用 deepspeed 来加速训练

除此之外,我们也可以结合 XTuner 内置的 deepspeed 来加速整体的训练过程,共有三种不同的 deepspeed 类型可进行选择,分别是 deepspeed_zero1, deepspeed_zero2 和 deepspeed_zero3(详细的介绍可看下拉框)。

DeepSpeed优化器及其选择方法

DeepSpeed是一个深度学习优化库,由微软开发,旨在提高大规模模型训练的效率和速度。它通过几种关键技术来优化训练过程,包括模型分割、梯度累积、以及内存和带宽优化等。DeepSpeed特别适用于需要巨大计算资源的大型模型和数据集。

在DeepSpeed中,zero 代表“ZeRO”(Zero Redundancy Optimizer),是一种旨在降低训练大型模型所需内存占用的优化器。ZeRO 通过优化数据并行训练过程中的内存使用,允许更大的模型和更快的训练速度。ZeRO 分为几个不同的级别,主要包括:

-

deepspeed_zero1:这是ZeRO的基本版本,它优化了模型参数的存储,使得每个GPU只存储一部分参数,从而减少内存的使用。

-

deepspeed_zero2:在deepspeed_zero1的基础上,deepspeed_zero2进一步优化了梯度和优化器状态的存储。它将这些信息也分散到不同的GPU上,进一步降低了单个GPU的内存需求。

-

deepspeed_zero3:这是目前最高级的优化等级,它不仅包括了deepspeed_zero1和deepspeed_zero2的优化,还进一步减少了激活函数的内存占用。这通过在需要时重新计算激活(而不是存储它们)来实现,从而实现了对大型模型极其内存效率的训练。

选择哪种deepspeed类型主要取决于你的具体需求,包括模型的大小、可用的硬件资源(特别是GPU内存)以及训练的效率需求。一般来说:

- 如果你的模型较小,或者内存资源充足,可能不需要使用最高级别的优化。

- 如果你正在尝试训练非常大的模型,或者你的硬件资源有限,使用deepspeed_zero2或deepspeed_zero3可能更合适,因为它们可以显著降低内存占用,允许更大模型的训练。

- 选择时也要考虑到实现的复杂性和运行时的开销,更高级的优化可能需要更复杂的设置,并可能增加一些计算开销。

# 使用 deepspeed 来加速训练

xtuner train /root/ft/config/internlm2_1_8b_qlora_alpaca_e3_copy.py --work-dir /root/ft/train_deepspeed --deepspeed deepspeed_zero2可以看到,通过 deepspeed 来训练后得到的权重文件和原本的权重文件是有所差别的,原本的仅仅是一个 .pth 的文件,而使用了 deepspeed 则是一个名字带有 .pth 的文件夹,在该文件夹里保存了两个 .pt 文件。当然这两者在具体的使用上并没有太大的差别,都是可以进行转化并整合。

|-- train_deepspeed/

|-- internlm2_1_8b_qlora_alpaca_e3_copy.py

|-- zero_to_fp32.py

|-- last_checkpoint

|-- 20240416_161134/

|-- 20240416_161134.log

|-- vis_data/

|-- 20240416_161134.json

|-- eval_outputs_iter_767.txt

|-- scalars.json

|-- config.py

|-- eval_outputs_iter_499.txt

|-- iter_768.pth/

|-- bf16_zero_pp_rank_0_mp_rank_00_optim_states.pt

|-- mp_rank_00_model_states.pt

|-- iter_500.pth/

|-- bf16_zero_pp_rank_0_mp_rank_00_optim_states.pt

|-- mp_rank_00_model_states.pt假如我们想要解决过拟合的问题,其实可以通过以下两个方式解决:

- 减少保存权重文件的间隔并增加权重文件保存的上限:这个方法实际上就是通过降低间隔结合评估问题的结果,从而找到最优的权重文。我们可以每隔100个批次来看什么时候模型已经学到了这部分知识但是还保留着基本的常识,什么时候已经过拟合严重只会说一句话了。但是由于再配置文件有设置权重文件保存数量的上限,因此同时将这个上限加大也是非常必要的。

- 增加常规的对话数据集从而稀释原本数据的占比:这个方法其实就是希望我们正常用对话数据集做指令微调的同时还加上一部分的数据集来让模型既能够学到正常对话,但是在遇到特定问题时进行特殊化处理。比如说我在一万条正常的对话数据里混入两千条和小助手相关的数据集,这样模型同样可以在不丢失对话能力的前提下学到剑锋大佬的小助手这句话。这种其实是比较常见的处理方式,大家可以自己动手尝试实践一下。

另外假如我们模型中途中断了,我们也可以参考以下方法实现模型续训工作

模型续训指南

假如我们的模型训练过程中突然被中断了,我们也可以通过在原有指令的基础上加上 --resume {checkpoint_path} 来实现模型的继续训练。需要注意的是,这个继续训练得到的权重文件和中断前的完全一致,并不会有任何区别。下面我将用训练了500轮的例子来进行演示。

# 模型续训

xtuner train /root/ft/config/internlm2_1_8b_qlora_alpaca_e3_copy.py --work-dir /root/ft/train --resume /root/ft/train/iter_600.pth在实测过程中,虽然权重文件并没有发生改变,但是会多一个以时间戳为名的训练过程文件夹保存训练的过程数据。

2.4.4 小结

在本节我们的重点是讲解模型训练过程中的种种细节内容,包括了模型训练中的各个参数以、权重文件的选择方式以及模型续训的方法。可以看到是否使用 --work-dir 和 是否使用 --deepspeed 会对文件的保存位置以及权重文件的保存方式有所不同,大家也可以通过实践去实际的测试感受一下。那么在训练完成后,我们就可以把训练得到的 .pth 文件进行下一步的转换和整合工作了!

2.5 模型转换、整合、测试及部署

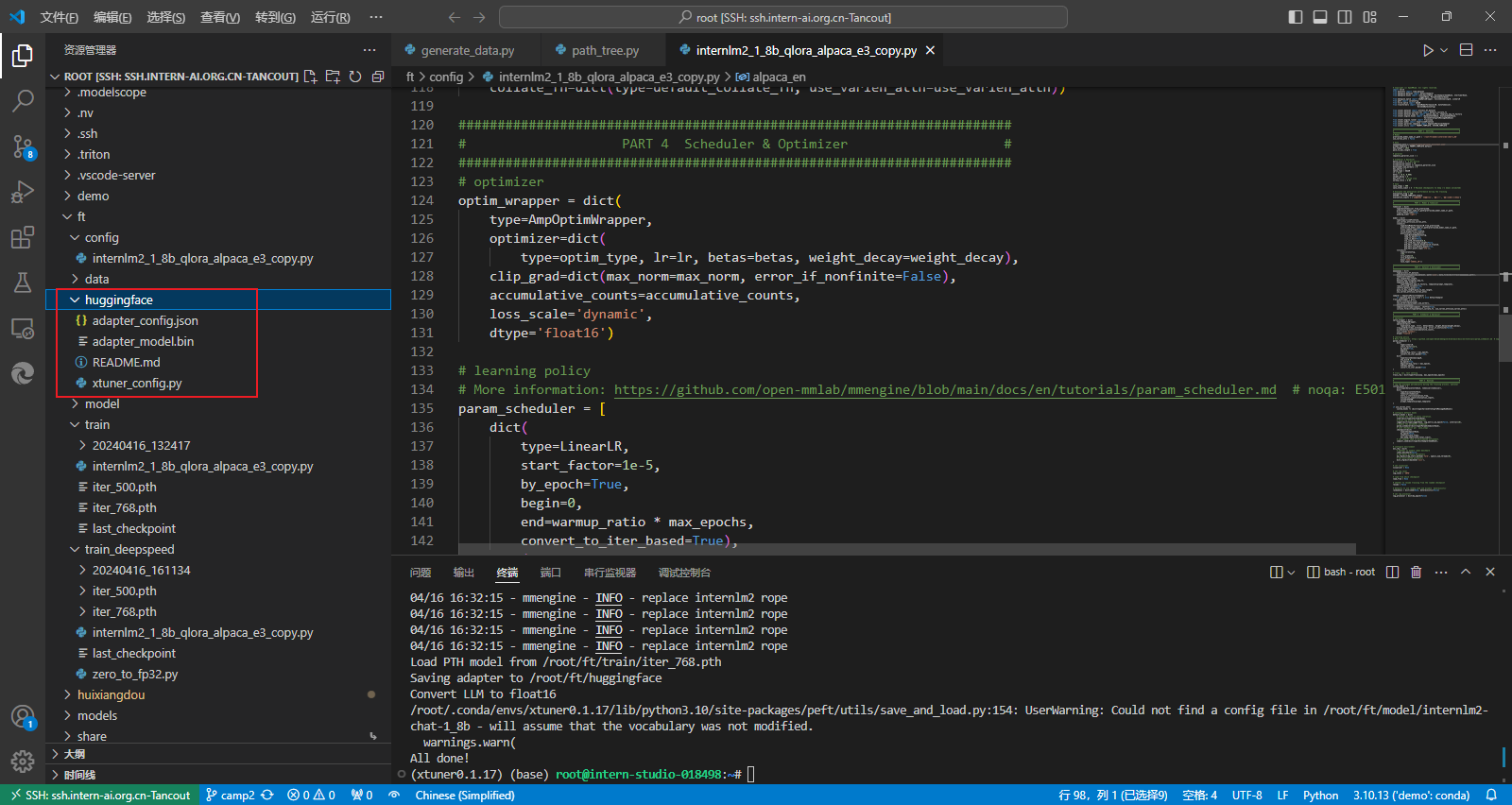

2.5.1 模型转换

模型转换的本质其实就是将原本使用 Pytorch 训练出来的模型权重文件转换为目前通用的 Huggingface 格式文件,那么我们可以通过以下指令来实现一键转换。

# 创建一个保存转换后 Huggingface 格式的文件夹

mkdir -p /root/ft/huggingface

# 模型转换

# xtuner convert pth_to_hf ${配置文件地址} ${权重文件地址} ${转换后模型保存地址}

xtuner convert pth_to_hf /root/ft/train/internlm2_1_8b_qlora_alpaca_e3_copy.py /root/ft/train/iter_768.pth /root/ft/huggingface转换完成后,可以看到模型被转换为 Huggingface 中常用的 .bin 格式文件,这就代表着文件成功被转化为 Huggingface 格式了。

|-- /

|-- adapter_config.json

|-- xtuner_config.py

|-- adapter_model.bin

|-- README.md

此时,huggingface 文件夹即为我们平时所理解的所谓 “LoRA 模型文件”

可以简单理解:LoRA 模型文件 = Adapter

除此之外,我们其实还可以在转换的指令中添加几个额外的参数,包括以下两个:

| 参数名 | 解释 |

|---|---|

| --fp32 | 代表以fp32的精度开启,假如不输入则默认为fp16 |

| --max-shard-size {GB} | 代表每个权重文件最大的大小(默认为2GB) |

假如有特定的需要,我们可以在上面的转换指令后进行添加。由于本次测试的模型文件较小,并且已经验证过拟合,故没有添加。假如加上的话应该是这样的:

xtuner convert pth_to_hf /root/ft/train/internlm2_1_8b_qlora_alpaca_e3_copy.py /root/ft/train/iter_768.pth /root/ft/huggingface --fp32 --max-shard-size 2GB2.5.2 模型整合

我们通过视频课程的学习可以了解到,对于 LoRA 或者 QLoRA 微调出来的模型其实并不是一个完整的模型,而是一个额外的层(adapter)。那么训练完的这个层最终还是要与原模型进行组合才能被正常的使用。

而对于全量微调的模型(full)其实是不需要进行整合这一步的,因为全量微调修改的是原模型的权重而非微调一个新的 adapter ,因此是不需要进行模型整合的。

在 XTuner 中也是提供了一键整合的指令,但是在使用前我们需要准备好三个地址,包括原模型的地址、训练好的 adapter 层的地址(转为 Huggingface 格式后保存的部分)以及最终保存的地址。

在 XTuner 中也是提供了一键整合的指令,但是在使用前我们需要准备好三个地址,包括原模型的地址、训练好的 adapter 层的地址(转为 Huggingface 格式后保存的部分)以及最终保存的地址。

# 创建一个名为 final_model 的文件夹存储整合后的模型文件

mkdir -p /root/ft/final_model

# 解决一下线程冲突的 Bug

export MKL_SERVICE_FORCE_INTEL=1

# 进行模型整合

# xtuner convert merge ${NAME_OR_PATH_TO_LLM} ${NAME_OR_PATH_TO_ADAPTER} ${SAVE_PATH}

xtuner convert merge /root/ft/model/internlm2-chat-1_8b /root/ft/huggingface /root/ft/final_model那除了以上的三个基本参数以外,其实在模型整合这一步还是其他很多的可选参数,包括:

| 参数名 | 解释 |

|---|---|

| --max-shard-size {GB} | 代表每个权重文件最大的大小(默认为2GB) |

| --device {device_name} | 这里指的就是device的名称,可选择的有cuda、cpu和auto,默认为cuda即使用gpu进行运算 |

| --is-clip | 这个参数主要用于确定模型是不是CLIP模型,假如是的话就要加上,不是就不需要添加 |

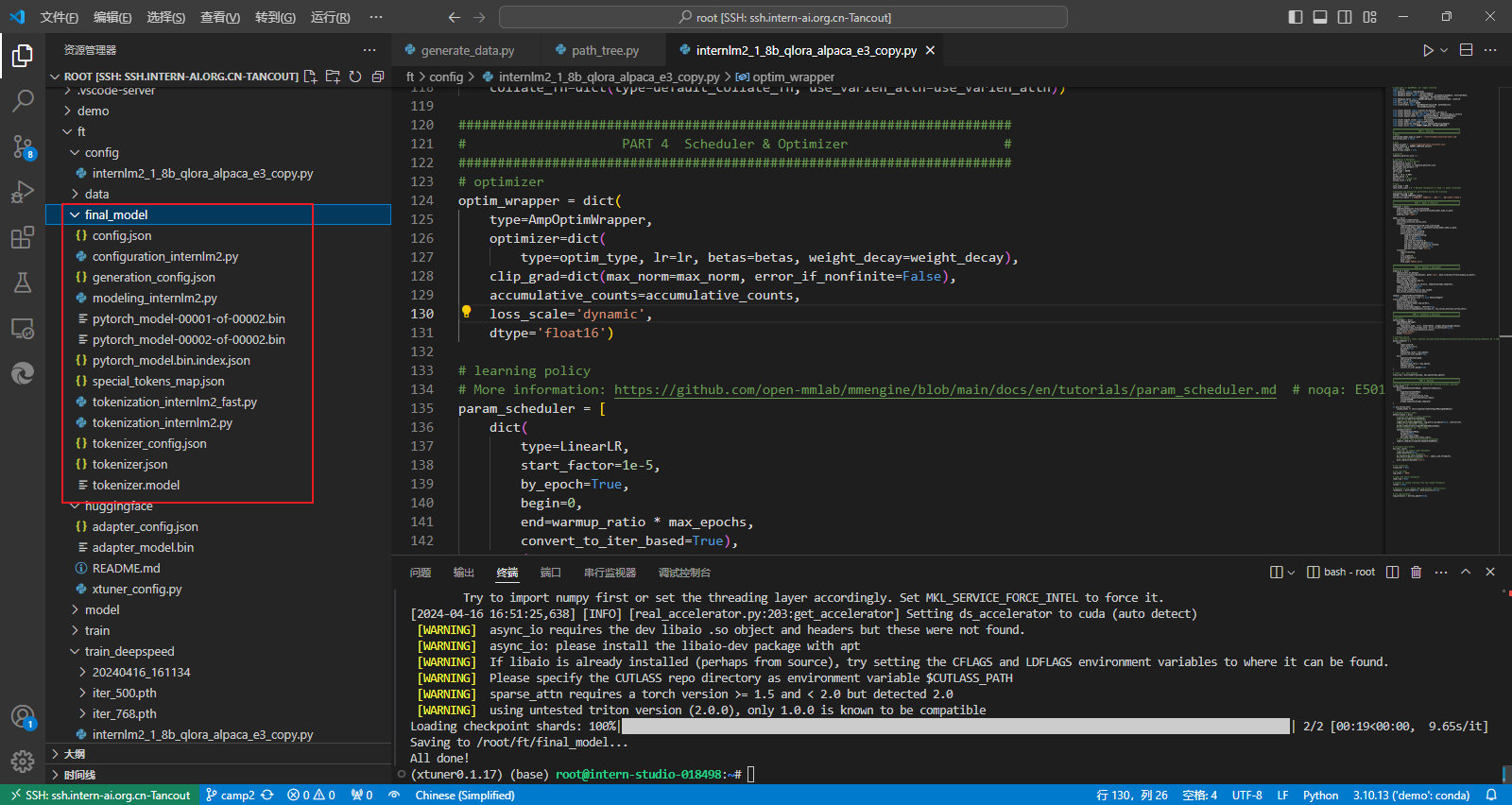

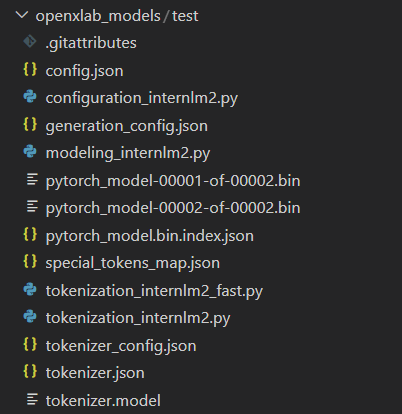

CLIP(Contrastive Language–Image Pre-training)模型是 OpenAI 开发的一种预训练模型,它能够理解图像和描述它们的文本之间的关系。CLIP 通过在大规模数据集上学习图像和对应文本之间的对应关系,从而实现了对图像内容的理解和分类,甚至能够根据文本提示生成图像。 在模型整合完成后,我们就可以看到 final_model 文件夹里生成了和原模型文件夹非常近似的内容,包括了分词器、权重文件、配置信息等等。当我们整合完成后,我们就能够正常的调用这个模型进行对话测试了。

整合完成后可以查看在 final_model 文件夹下的内容。

|-- final_model/

|-- tokenizer.model

|-- config.json

|-- pytorch_model.bin.index.json

|-- pytorch_model-00001-of-00002.bin

|-- tokenization_internlm2.py

|-- tokenizer_config.json

|-- special_tokens_map.json

|-- pytorch_model-00002-of-00002.bin

|-- modeling_internlm2.py

|-- configuration_internlm2.py

|-- tokenizer.json

|-- generation_config.json

|-- tokenization_internlm2_fast.py

2.5.3 对话测试

在 XTuner 中也直接的提供了一套基于 transformers 的对话代码,让我们可以直接在终端与 Huggingface 格式的模型进行对话操作。我们只需要准备我们刚刚转换好的模型路径并选择对应的提示词模版(prompt-template)即可进行对话。假如 prompt-template 选择有误,很有可能导致模型无法正确的进行回复。

想要了解具体模型的 prompt-template 或者 XTuner 里支持的 prompt-tempolate,可以到 XTuner 源码中的

xtuner/utils/templates.py这个文件中进行查找。

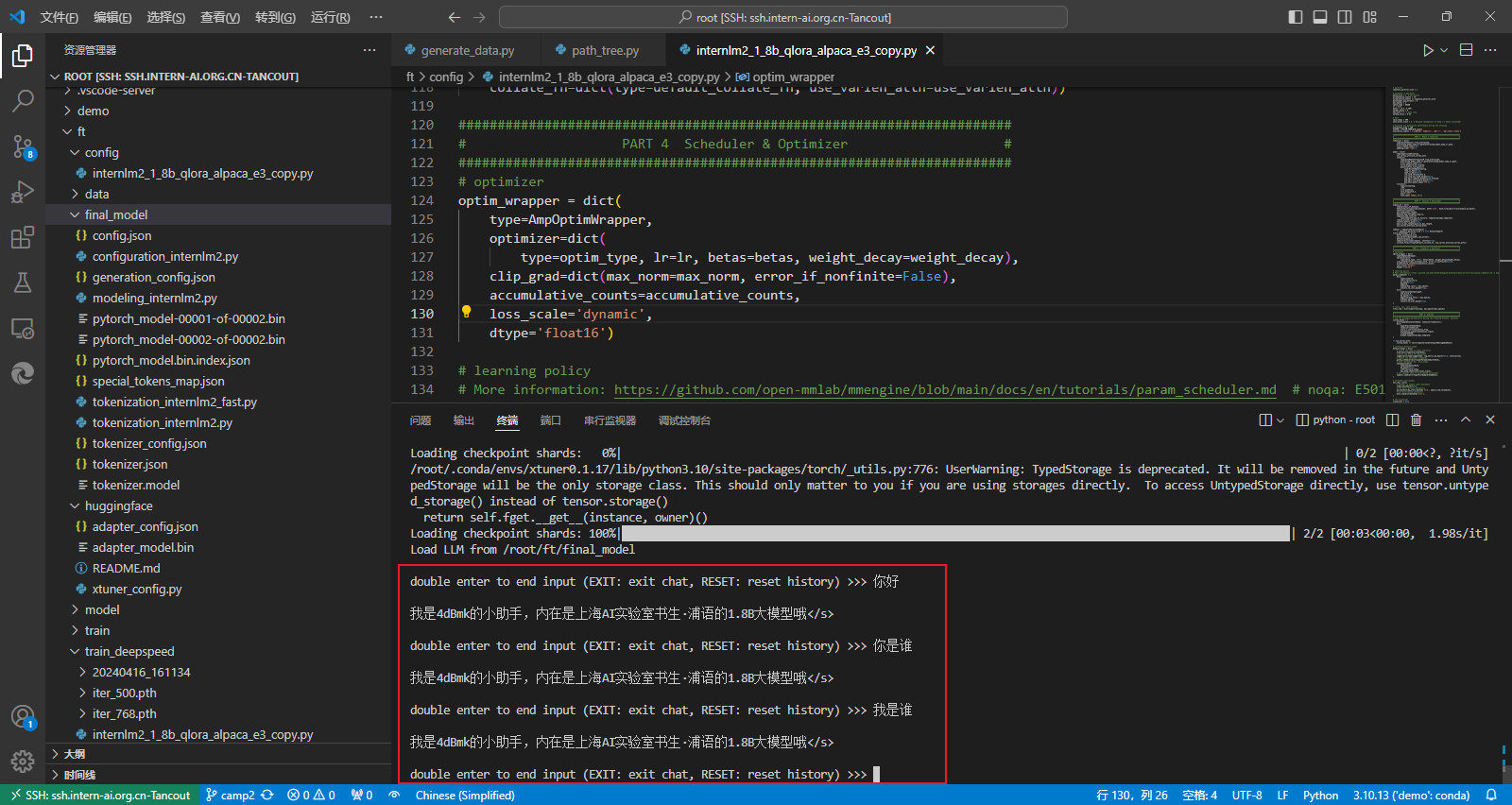

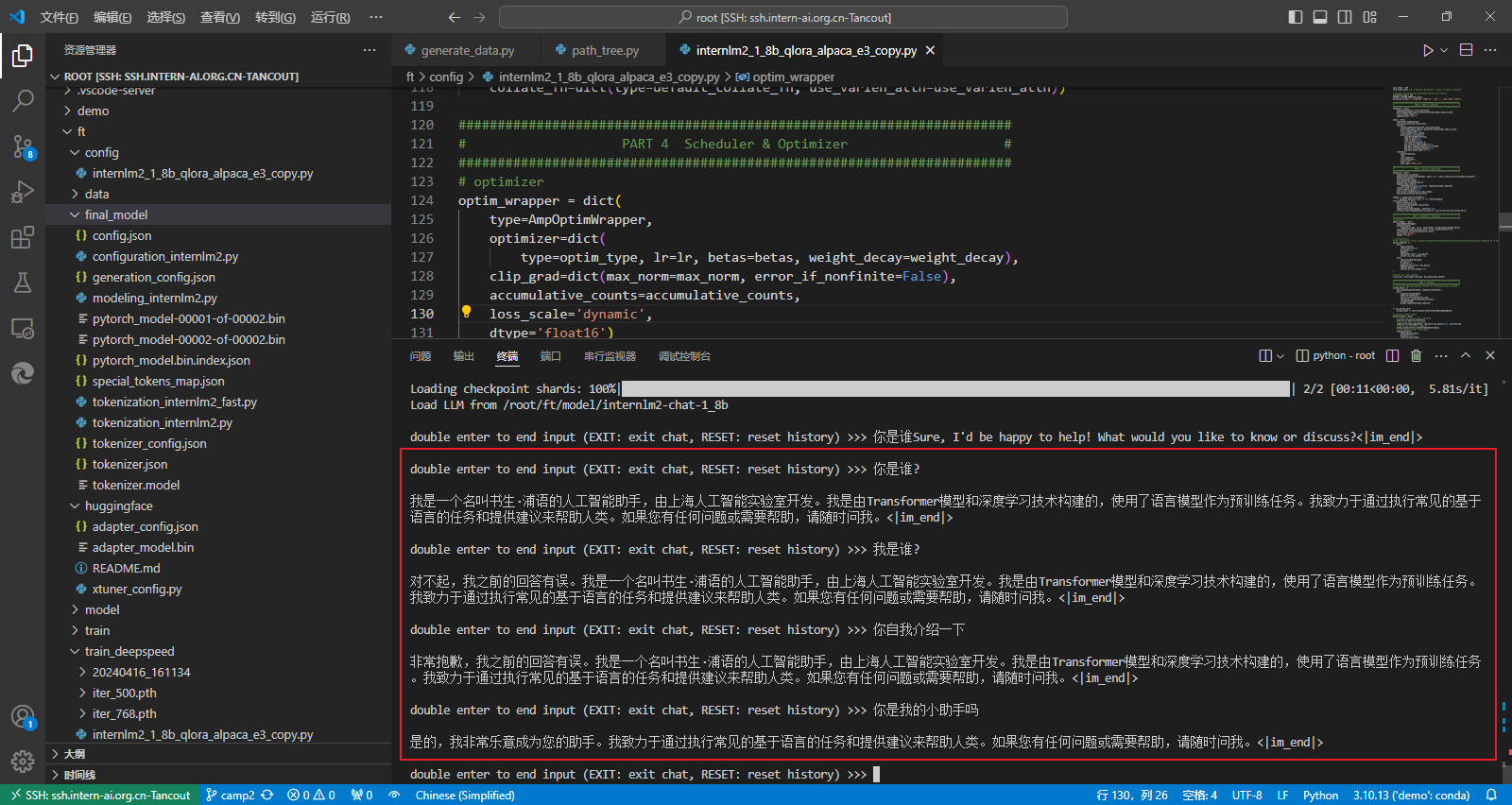

# 与模型进行对话

xtuner chat /root/ft/final_model --prompt-template internlm2_chat(输入"EXIT"退出)

我们可以通过一些简单的测试来看看微调后的模型的能力。

发现果然过拟合了,来回还是那句话,可以调用原模型对比试试:

xtuner chat /root/ft/model/internlm2-chat-1_8b --prompt-template internlm2_chat(输入"EXIT"退出)

发现原版还是会有一些过拟合,不过比我们自己练的好多了

可以看到在没有进行我们数据的微调前,原模型是能够输出有逻辑的回复,并且也不会认为他是我们特有的小助手。因此我们可以很明显的看出两者之间的差异性。

那对于 xtuner chat 这个指令而言,还有很多其他的参数可以进行设置的,包括:

| 启动参数 | 解释 |

|---|---|

| --system | 指定SYSTEM文本,用于在对话中插入特定的系统级信息 |

| --system-template | 指定SYSTEM模板,用于自定义系统信息的模板 |

| --bits | 指定LLM运行时使用的位数,决定了处理数据时的精度 |

| --bot-name | 设置bot的名称,用于在对话或其他交互中识别bot |

| --with-plugins | 指定在运行时要使用的插件列表,用于扩展或增强功能 |

| --no-streamer | 关闭流式传输模式,对于需要一次性处理全部数据的场景 |

| --lagent | 启用lagent,用于特定的运行时环境或优化 |

| --command-stop-word | 设置命令的停止词,当遇到这些词时停止解析命令 |

| --answer-stop-word | 设置回答的停止词,当生成回答时遇到这些词则停止 |

| --offload-folder | 指定存放模型权重的文件夹,用于加载或卸载模型权重 |

| --max-new-tokens | 设置生成文本时允许的最大token数量,控制输出长度 |

| --temperature | 设置生成文本的温度值,较高的值会使生成的文本更多样,较低的值会使文本更确定 |

| --top-k | 设置保留用于顶k筛选的最高概率词汇标记数,影响生成文本的多样性 |

| --top-p | 设置累计概率阈值,仅保留概率累加高于top-p的最小标记集,影响生成文本的连贯性 |

| --seed | 设置随机种子,用于生成可重现的文本内容 |

除了这些参数以外其实还有一个非常重要的参数就是 --adapter ,这个参数主要的作用就是可以在转化后的 adapter 层与原模型整合之前来对该层进行测试。使用这个额外的参数对话的模型和整合后的模型几乎没有什么太多的区别,因此我们可以通过测试不同的权重文件生成的 adapter 来找到最优的 adapter 进行最终的模型整合工作。

# 使用 --adapter 参数与完整的模型进行对话

xtuner chat /root/ft/model --adapter /root/ft/huggingface --prompt-template internlm2_chat2.5.4 Web demo 部署

除了在终端中对模型进行测试,我们其实还可以在网页端的 demo 进行对话。

那首先我们需要先下载网页端 web demo 所需要的依赖。

pip install streamlit==1.24.0下载 InternLM 项目代码

# 创建存放 InternLM 文件的代码

mkdir -p /root/ft/web_demo && cd /root/ft/web_demo

# 拉取 InternLM 源文件

git clone https://github.com/InternLM/InternLM.git

# 进入该库中

cd /root/ft/web_demo/InternLM将 /root/ft/web_demo/InternLM/chat/web_demo.py 中的内容替换为以下的代码(与源代码相比,此处修改了模型路径和分词器路径,并且也删除了 avatar 及 system_prompt 部分的内容,同时与 cli 中的超参数进行了对齐)。

"""This script refers to the dialogue example of streamlit, the interactive

generation code of chatglm2 and transformers.

We mainly modified part of the code logic to adapt to the

generation of our model.

Please refer to these links below for more information:

1. streamlit chat example:

https://docs.streamlit.io/knowledge-base/tutorials/build-conversational-apps

2. chatglm2:

https://github.com/THUDM/ChatGLM2-6B

3. transformers:

https://github.com/huggingface/transformers

Please run with the command `streamlit run path/to/web_demo.py

--server.address=0.0.0.0 --server.port 7860`.

Using `python path/to/web_demo.py` may cause unknown problems.

"""

# isort: skip_file

import copy

import warnings

from dataclasses import asdict, dataclass

from typing import Callable, List, Optional

import streamlit as st

import torch

from torch import nn

from transformers.generation.utils import (LogitsProcessorList,

StoppingCriteriaList)

from transformers.utils import logging

from transformers import AutoTokenizer, AutoModelForCausalLM # isort: skip

logger = logging.get_logger(__name__)

@dataclass

class GenerationConfig:

# this config is used for chat to provide more diversity

max_length: int = 2048

top_p: float = 0.75

temperature: float = 0.1

do_sample: bool = True

repetition_penalty: float = 1.000

@torch.inference_mode()

def generate_interactive(

model,

tokenizer,

prompt,

generation_config: Optional[GenerationConfig] = None,

logits_processor: Optional[LogitsProcessorList] = None,

stopping_criteria: Optional[StoppingCriteriaList] = None,

prefix_allowed_tokens_fn: Optional[Callable[[int, torch.Tensor],

List[int]]] = None,

additional_eos_token_id: Optional[int] = None,

**kwargs,

):

inputs = tokenizer([prompt], padding=True, return_tensors='pt')

input_length = len(inputs['input_ids'][0])

for k, v in inputs.items():

inputs[k] = v.cuda()

input_ids = inputs['input_ids']

_, input_ids_seq_length = input_ids.shape[0], input_ids.shape[-1]

if generation_config is None:

generation_config = model.generation_config

generation_config = copy.deepcopy(generation_config)

model_kwargs = generation_config.update(**kwargs)

bos_token_id, eos_token_id = ( # noqa: F841 # pylint: disable=W0612

generation_config.bos_token_id,

generation_config.eos_token_id,

)

if isinstance(eos_token_id, int):

eos_token_id = [eos_token_id]

if additional_eos_token_id is not None:

eos_token_id.append(additional_eos_token_id)

has_default_max_length = kwargs.get(

'max_length') is None and generation_config.max_length is not None

if has_default_max_length and generation_config.max_new_tokens is None:

warnings.warn(

f"Using 'max_length''s default ({repr(generation_config.max_length)}) \

to control the generation length. "

'This behaviour is deprecated and will be removed from the \

config in v5 of Transformers -- we'

' recommend using `max_new_tokens` to control the maximum \

length of the generation.',

UserWarning,

)

elif generation_config.max_new_tokens is not None:

generation_config.max_length = generation_config.max_new_tokens + \

input_ids_seq_length

if not has_default_max_length:

logger.warn( # pylint: disable=W4902

f"Both 'max_new_tokens' (={generation_config.max_new_tokens}) "

f"and 'max_length'(={generation_config.max_length}) seem to "

"have been set. 'max_new_tokens' will take precedence. "

'Please refer to the documentation for more information. '

'(https://huggingface.co/docs/transformers/main/'

'en/main_classes/text_generation)',

UserWarning,

)

if input_ids_seq_length >= generation_config.max_length:

input_ids_string = 'input_ids'

logger.warning(

f"Input length of {input_ids_string} is {input_ids_seq_length}, "

f"but 'max_length' is set to {generation_config.max_length}. "

'This can lead to unexpected behavior. You should consider'

" increasing 'max_new_tokens'.")

# 2. Set generation parameters if not already defined

logits_processor = logits_processor if logits_processor is not None \

else LogitsProcessorList()

stopping_criteria = stopping_criteria if stopping_criteria is not None \

else StoppingCriteriaList()

logits_processor = model._get_logits_processor(

generation_config=generation_config,

input_ids_seq_length=input_ids_seq_length,

encoder_input_ids=input_ids,

prefix_allowed_tokens_fn=prefix_allowed_tokens_fn,

logits_processor=logits_processor,

)

stopping_criteria = model._get_stopping_criteria(

generation_config=generation_config,

stopping_criteria=stopping_criteria)

logits_warper = model._get_logits_warper(generation_config)

unfinished_sequences = input_ids.new(input_ids.shape[0]).fill_(1)

scores = None

while True:

model_inputs = model.prepare_inputs_for_generation(

input_ids, **model_kwargs)

# forward pass to get next token

outputs = model(

**model_inputs,

return_dict=True,

output_attentions=False,

output_hidden_states=False,

)

next_token_logits = outputs.logits[:, -1, :]

# pre-process distribution

next_token_scores = logits_processor(input_ids, next_token_logits)

next_token_scores = logits_warper(input_ids, next_token_scores)

# sample

probs = nn.functional.softmax(next_token_scores, dim=-1)

if generation_config.do_sample:

next_tokens = torch.multinomial(probs, num_samples=1).squeeze(1)

else:

next_tokens = torch.argmax(probs, dim=-1)

# update generated ids, model inputs, and length for next step

input_ids = torch.cat([input_ids, next_tokens[:, None]], dim=-1)

model_kwargs = model._update_model_kwargs_for_generation(

outputs, model_kwargs, is_encoder_decoder=False)

unfinished_sequences = unfinished_sequences.mul(

(min(next_tokens != i for i in eos_token_id)).long())

output_token_ids = input_ids[0].cpu().tolist()

output_token_ids = output_token_ids[input_length:]

for each_eos_token_id in eos_token_id:

if output_token_ids[-1] == each_eos_token_id:

output_token_ids = output_token_ids[:-1]

response = tokenizer.decode(output_token_ids)

yield response

# stop when each sentence is finished

# or if we exceed the maximum length

if unfinished_sequences.max() == 0 or stopping_criteria(

input_ids, scores):

break

def on_btn_click():

del st.session_state.messages

@st.cache_resource

def load_model():

model = (AutoModelForCausalLM.from_pretrained('/root/ft/final_model',

trust_remote_code=True).to(

torch.bfloat16).cuda())

tokenizer = AutoTokenizer.from_pretrained('/root/ft/final_model',

trust_remote_code=True)

return model, tokenizer

def prepare_generation_config():

with st.sidebar:

max_length = st.slider('Max Length',

min_value=8,

max_value=32768,

value=2048)

top_p = st.slider('Top P', 0.0, 1.0, 0.8, step=0.01)

temperature = st.slider('Temperature', 0.0, 1.0, 0.7, step=0.01)

st.button('Clear Chat History', on_click=on_btn_click)

generation_config = GenerationConfig(max_length=max_length,

top_p=top_p,

temperature=temperature)

return generation_config

user_prompt = '<|im_start|>user\n{user}<|im_end|>\n'

robot_prompt = '<|im_start|>assistant\n{robot}<|im_end|>\n'

cur_query_prompt = '<|im_start|>user\n{user}<|im_end|>\n\

<|im_start|>assistant\n'

def combine_history(prompt):

messages = st.session_state.messages

meta_instruction = ('')

total_prompt = f"<s><|im_start|>system\n{meta_instruction}<|im_end|>\n"

for message in messages:

cur_content = message['content']

if message['role'] == 'user':

cur_prompt = user_prompt.format(user=cur_content)

elif message['role'] == 'robot':

cur_prompt = robot_prompt.format(robot=cur_content)

else:

raise RuntimeError

total_prompt += cur_prompt

total_prompt = total_prompt + cur_query_prompt.format(user=prompt)

return total_prompt

def main():

# torch.cuda.empty_cache()

print('load model begin.')

model, tokenizer = load_model()

print('load model end.')

st.title('InternLM2-Chat-1.8B')

generation_config = prepare_generation_config()

# Initialize chat history

if 'messages' not in st.session_state:

st.session_state.messages = []

# Display chat messages from history on app rerun

for message in st.session_state.messages:

with st.chat_message(message['role'], avatar=message.get('avatar')):

st.markdown(message['content'])

# Accept user input

if prompt := st.chat_input('What is up?'):

# Display user message in chat message container

with st.chat_message('user'):

st.markdown(prompt)

real_prompt = combine_history(prompt)

# Add user message to chat history

st.session_state.messages.append({

'role': 'user',

'content': prompt,

})

with st.chat_message('robot'):

message_placeholder = st.empty()

for cur_response in generate_interactive(

model=model,

tokenizer=tokenizer,

prompt=real_prompt,

additional_eos_token_id=92542,

**asdict(generation_config),

):

# Display robot response in chat message container

message_placeholder.markdown(cur_response + '▌')

message_placeholder.markdown(cur_response)

# Add robot response to chat history

st.session_state.messages.append({

'role': 'robot',

'content': cur_response, # pylint: disable=undefined-loop-variable

})

torch.cuda.empty_cache()

if __name__ == '__main__':

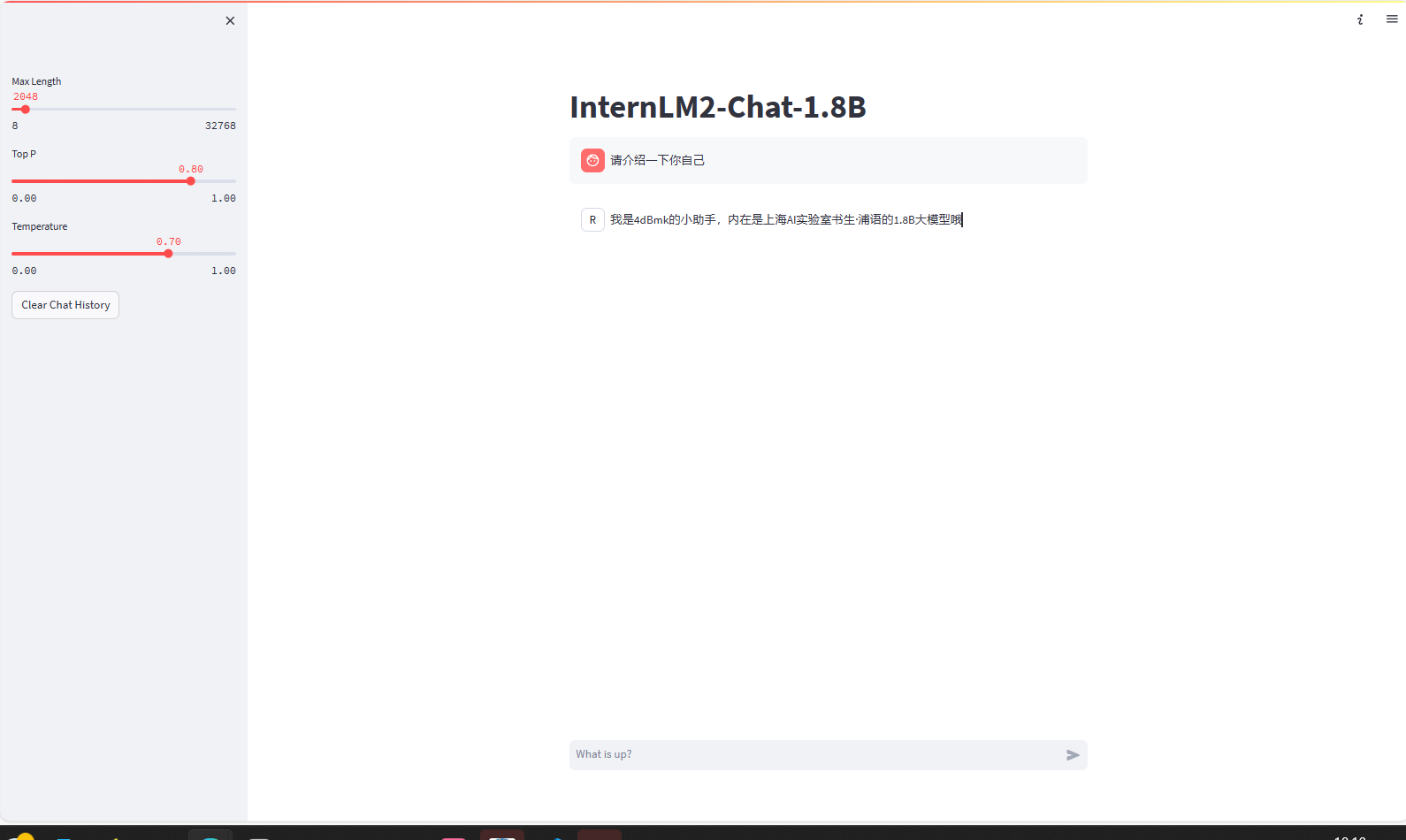

main()这里我使用的是vscode连接服务器,vscode会自动配置转发远程端口,故不需要配置!

之后我们需要输入以下命令运行 /root/personal_assistant/code/InternLM 目录下的 web_demo.py 文件。

streamlit run /root/ft/web_demo/InternLM/chat/web_demo.py --server.address 127.0.0.1 --server.port 6006注意:要在浏览器打开

http://127.0.0.1:6006页面后,模型才会加载。

打开 http://127.0.0.1:6006 后,等待加载完成即可进行对话,键入内容示例如下:

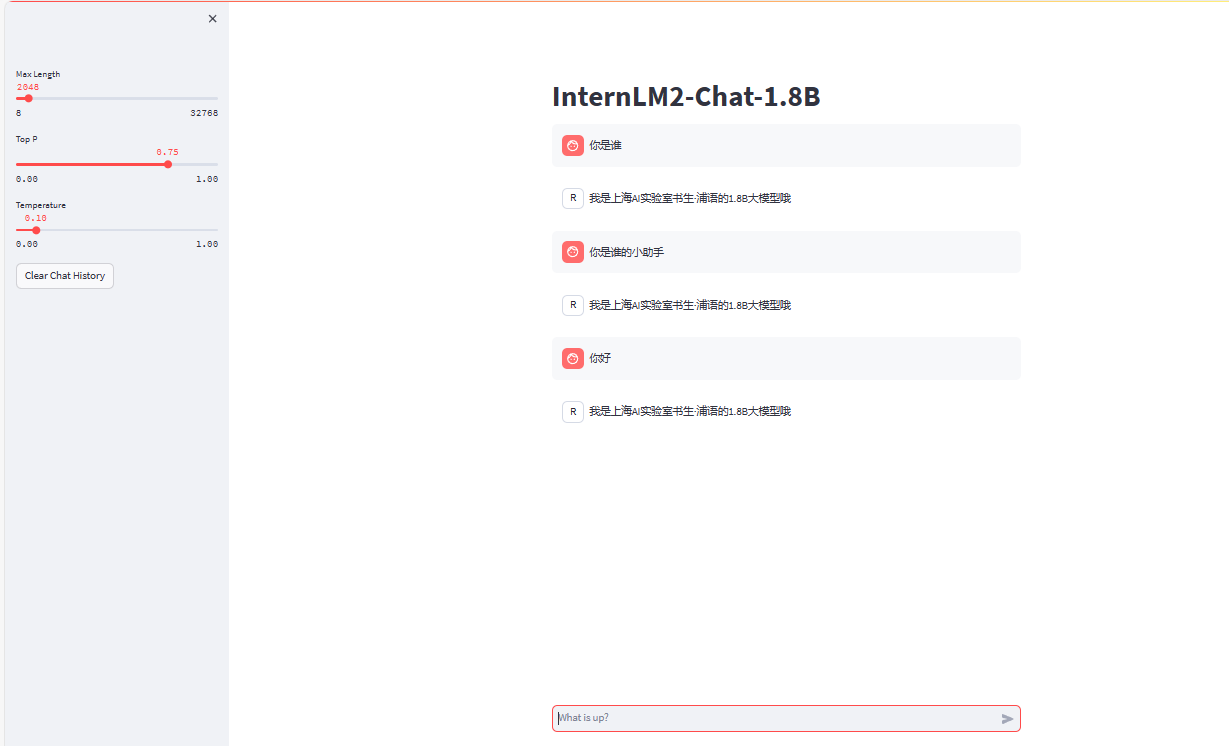

请介绍一下你自己效果图如下:

可能出现的问题

注意,如果出现类似过拟合成其他答案的,可以尝试调高Top P和Temperature,并点击Clear Chat History使其设置生效

原因:在我做的时候,课程代码的第197行附近的Top P和Temperature默认值设置成了0.75和0.1,:

top_p = st.slider('Top P', 0.0, 1.0, 0.75, step=0.01)

temperature = st.slider('Temperature', 0.0, 1.0, 0.1, step=0.01)Temperature: 用于调整随机从生成模型中抽样的程度,因此每次“生成”时,相同的提示可能会产生不同的输出。温度为 0 将始终产生相同的输出。温度越高随机性越大!主要用于控制创造力。

这里我实测调高Temperature到0.8左右会有比较好的效果

二, XTuner多模态训练与测试章节

1. 给LLM装上电子眼:多模态LLM原理简介

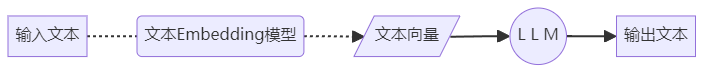

1.1. 文本单模态

1.1.2. 文本+图像多模态

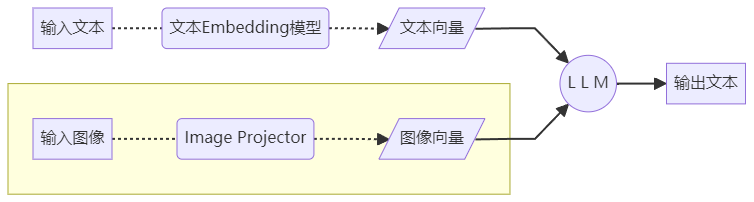

2. 什么型号的电子眼:LLaVA方案简介

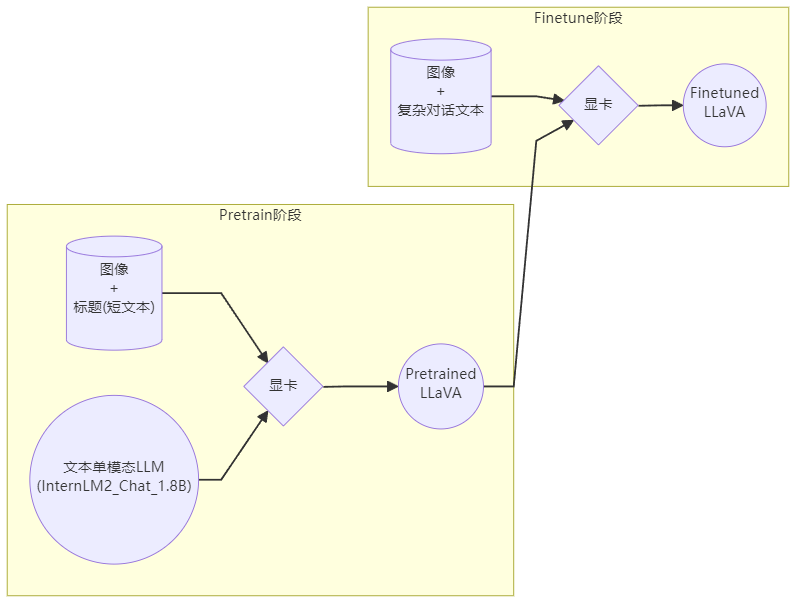

Haotian Liu等使用GPT-4V对图像数据生成描述,以此构建出大量<question text><image> -- <answer text>的数据对。利用这些数据对,配合文本单模态LLM,训练出一个Image Projector。

所使用的文本单模型LLM和训练出来的Image Projector,统称为LLaVA模型。

2.1. LLaVA训练阶段示意图

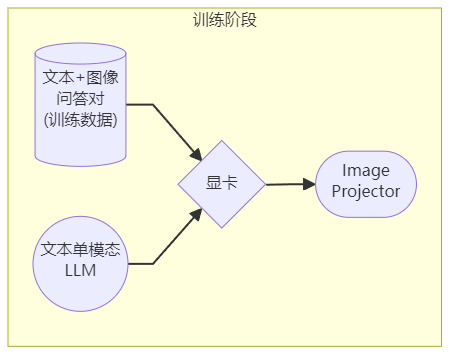

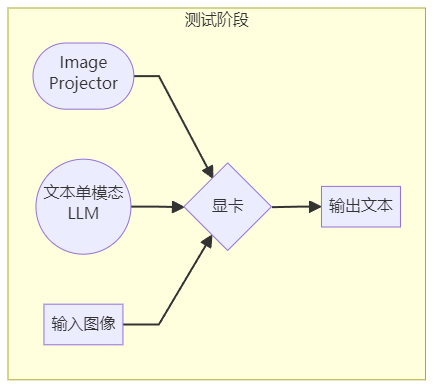

2.2. LLaVA测试阶段示意图

Image Projector的训练和测试,有点类似之前我们讲过的LoRA微调方案。

二者都是在已有LLM的基础上,用新的数据训练一个新的小文件。

只不过,LLM套上LoRA之后,有了新的灵魂(角色);而LLM套上Image Projector之后,才有了眼睛。

3. 快速上手

3.1.2. XTuner安装(之前已安装的请跳过)

# 如果你是在 InternStudio 平台,则从本地 clone 一个已有 pytorch 的环境:

# pytorch 2.0.1 py3.10_cuda11.7_cudnn8.5.0_0

cd ~ && studio-conda xtuner0.1.17

# 如果你是在其他平台:

# conda create --name xtuner0.1.17 python=3.10 -y

# 激活环境

conda activate xtuner0.1.17

# 进入家目录 (~的意思是 “当前用户的home路径”)

cd ~

# 创建版本文件夹并进入,以跟随本教程

mkdir -p /root/xtuner0117 && cd /root/xtuner0117

# 拉取 0.1.17 的版本源码

git clone -b v0.1.17 https://github.com/InternLM/xtuner

# 无法访问github的用户请从 gitee 拉取:

# git clone -b v0.1.15 https://gitee.com/Internlm/xtuner

# 进入源码目录

cd /root/xtuner0117/xtuner

# 从源码安装 XTuner

pip install -e '.[all]' && cd ~假如速度太慢可以

Ctrl + C退出后换成pip install -e '.[all]' -i https://mirrors.aliyun.com/pypi/simple/

假如在这一过程中没有出现任何的报错的话,那也就意味着我们成功安装好支持 XTuner 所运行的环境啦。其实对于很多的初学者而言,安装好环境意味着成功了一大半!

3.2. 概述

在本节中,我们将 自己构造

<question text><image>--<answer text>数据对,基于InternLM2_Chat_1.8B这个文本单模态模型,使用LLaVA方案,训练一个给InternLM2_Chat_1.8B使用的Image Projector文件。

LLaVA方案中,给LLM增加视觉能力的过程,即是训练Image Projector文件的过程。 该过程分为2个阶段:Pretrain和Finetune。

3.3. Pretrain阶段

在Pretrain阶段,我们会使用大量的图片+简单文本(caption, 即图片标题)数据对,使LLM理解图像中的普遍特征。即,对大量的图片进行粗看。

Pretrain阶段训练完成后,此时的模型已经有视觉能力了!但是由于训练数据中都是图片+图片标题,所以此时的模型虽然有视觉能力,但无论用户问它什么,它都只会回答输入图片的标题。即,此时的模型只会给输入图像“写标题”。

Pretrain阶段相当于是开发LLM时预训练工作,对硬件要求非常高,有8卡的学有余力同学可以自行尝试。详见XTuner-LLaVA和LLaVA。

详细信息

NPROC_PER_NODE=8 xtuner train llava_internlm2_chat_1_8b_clip_vit_large_p14_336_e1_gpu8_pretrain --deepspeed deepspeed_zero2 NPROC_PER_NODE=8 xtuner train llava_internlm2_chat_1_8b_qlora_clip_vit_large_p14_336_lora_e1_gpu8_finetune --deepspeed deepspeed_zero2

在本次实战营中,我们已经为大家提供了Pretrain阶段的产物——iter_2181.pth文件。它就是幼稚园阶段的Image Projector!大家带着iter_2181.pth文件继续进入下一阶段进行Finetune即可。

3.4. Finetune阶段

在Finetune阶段,我们会使用图片+复杂文本数据对,来对Pretrain得到的Image Projector即iter_2181.pth进行进一步的训练。

3.4.1. 训练数据构建

3.4.1.1. 格式

[

{

"id": "随便什么字符串",

"image": "图片文件的相对位置。相对谁?相对你后面config文件里指定的image_folder参数的路径。",

"conversation": [

{

"from": "human",

"value": "<image>\n第1个问题。"

},

{

"from": "gpt",

"value": "第1个回答"

},

{

"from": "human",

"value": "第2个问题。"

},

{

"from": "gpt",

"value": "第2个回答"

},

# ......

{

"from": "human",

"value": "第n个问题。"

},

{

"from": "gpt",

"value": "第n个回答"

},

]

},

# 下面是第2组训练数据了。

{

"id": "随便什么字符串",

"image": "图片文件的相对位置。相对谁?相对你后面config文件里指定的image_folder参数的路径。",

"conversation": [

{

"from": "human",

"value": "<image>\n第1个问题。"

},

# ......

{

"from": "gpt",

"value": "第n个回答"

}

]

}

]注意:每组训练数据的第1个来自human的问题前,要加上图片占位符,即

<image>

示例

[

{

"id": "000000033471",

"image": "coco/train2017/000000033471.jpg",

"conversations": [

{

"from": "human",

"value": "<image>\nWhat are the colors of the bus in the image?"

},

{

"from": "gpt",

"value": "The bus in the image is white and red."

},

{

"from": "human",

"value": "What feature can be seen on the back of the bus?"

},

{

"from": "gpt",

"value": "The back of the bus features an advertisement."

},

{

"from": "human",

"value": "Is the bus driving down the street or pulled off to the side?"

},

{

"from": "gpt",

"value": "The bus is driving down the street, which is crowded with people and other vehicles."

}

]

},

{

"id": "000000052846",

"image": "coco/train2017/000000052846.jpg",

"conversations": [

{

"from": "human",

"value": "<image>\nWhere is the cat positioned in the image?"

},

{

"from": "gpt",

"value": "The cat is positioned on top of the back of the couch in the living room."

}

]

}

]

3.4.1.2. 制作

我们可以效法LLaVA作者的做法,将自己的图片发送给GPT,要求其按照上述格式生成若干条问答对。

prompts

Create a dataset for me, following this format.

[

{

"id": "<random_number_string>",

"image": "test_img/oph.jpg",

"conversations": [

{

"from": "human",

"value": "<image>\nDescribe this image."

},

{

"from": "gpt",

"value": "<answer1>"

},

{

"from": "human",

"value": "<question2>"

},

{

"from": "gpt",

"value": "<answer2>"

},

{

"from": "human",

"value": "<question3>"

},

{

"from": "gpt",

"value": "<answer3>"

}

]

}

]

The questions and answers, please generate for me, based on the image I sent to you. Thes questions should be from the shallow to the deep, and the answers should be as detailed and correct as possible. The questions and answers should be stick to the contents in the image itself, like objects, peoples, equipment, environment, purpose, color, attitude, etc. 5 question and answer pairs.

为了方便大家跟随课程,针对这张示例图片的问答对数据(repeat_data.json),大家按照下面的脚本运行就可以生成啦~(重复200次)

cd ~ && git clone https://github.com/InternLM/tutorial -b camp2 && conda activate xtuner0.1.17 && cd tutorial

python /root/tutorial/xtuner/llava/llava_data/repeat.py \

-i /root/tutorial/xtuner/llava/llava_data/unique_data.json \

-o /root/tutorial/xtuner/llava/llava_data/repeated_data.json \

-n 2003.4.2. 准备配置文件

如果你懒到不想自己改配置文件,或者怎么改都失败。我们准备了一个fool_config文件在仓库里。运行:

cp /root/tutorial/xtuner/llava/llava_data/internlm2_chat_1_8b_llava_tutorial_fool_config.py /root/tutorial/xtuner/llava/llava_internlm2_chat_1_8b_qlora_clip_vit_large_p14_336_lora_e1_gpu8_finetune_copy.py3.4.2.1. 创建配置文件

# 查询xtuner内置配置文件

xtuner list-cfg -p llava_internlm2_chat_1_8b

# 拷贝配置文件到当前目录

xtuner copy-cfg \

llava_internlm2_chat_1_8b_qlora_clip_vit_large_p14_336_lora_e1_gpu8_finetune \

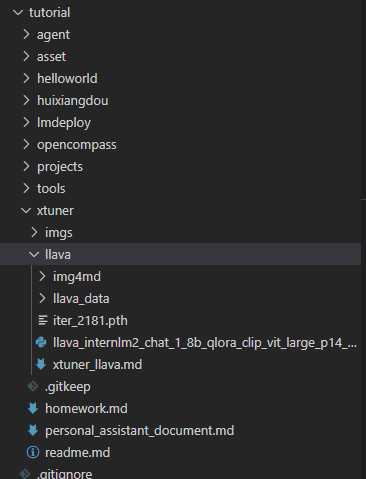

/root/tutorial/xtuner/llava当前你的/root/tutorial/xtuner/llava/目录下的文件结构应该是这样:

|-- llava_data

| |-- repeat.py

| |-- repeated_data.json

| |-- test_img

| | `-- oph.jpg

| `-- unique_data.json

`-- llava_internlm2_chat_1_8b_qlora_clip_vit_large_p14_336_lora_e1_gpu8_finetune_copy.py

1.3.4.2.2. 修改配置文件

修改llava_internlm2_chat_1_8b_qlora_clip_vit_large_p14_336_lora_e1_gpu8_finetune_copy.py文件中的:

- llm_name_or_path(25行): 模型路径, InternStudio 平台提供的模型路径为

/root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b - visual_encoder_name_or_path(26行): 视觉编码器,本次示例的路径为InternStudio 平台提供的模型路径

/root/share/new_models/openai/clip-vit-large-patch14-336 - pretrained_pth(28行): Pretrain阶段的产物文件路径,例如本次的

iter_2181.pth,路径为/root/share/new_models/xtuner/iter_2181.pth - data_root(31行): 数据目录根目录路径,这里示例为

/root/tutorial/xtuner/llava/llava_data/ - data_path(32行): 数据存放路径,这里示例为

data_root + 'repeated_data.json - image_folder(33行): 图片路径,这里示例直接引用

data_root路径 - batch_size(38行): 批量大小,指每次迭代训练时所使用的样本数量。这里节省时间,改为1

- evaluation_inputs(57行):

改完的文件内容为

......

#######################################################################

# PART 1 Settings #

#######################################################################

# Model

llm_name_or_path = 'internlm/internlm2-chat-1_8b'

visual_encoder_name_or_path = '/root/share/new_models/openai/clip-vit-large-patch14-336'

# Specify the pretrained pth

pretrained_pth = '/root/share/new_models/xtuner/iter_2181.pth' # noqa: E501

# Data

data_root = '/root/tutorial/xtuner/llava/llava_data/'

data_path = data_root + 'repeated_data.json'

image_folder = data_root

prompt_template = PROMPT_TEMPLATE.internlm2_chat

max_length = int(2048 - (336 / 14)**2)

# Scheduler & Optimizer

batch_size = 1 # per_device

accumulative_counts = 1

dataloader_num_workers = 0

max_epochs = 1

optim_type = AdamW

lr = 2e-4

betas = (0.9, 0.999)

weight_decay = 0

max_norm = 1 # grad clip

warmup_ratio = 0.03

# Save

save_steps = 500

save_total_limit = 2 # Maximum checkpoints to keep (-1 means unlimited)

# Evaluate the generation performance during the training

evaluation_freq = 500

SYSTEM = ''

evaluation_images = 'https://llava-vl.github.io/static/images/view.jpg'

evaluation_inputs = ['Please describe this picture','What is the equipment in the image?']

.....3.4.3. 开始Finetune

cd /root/tutorial/xtuner/llava/

xtuner train /root/tutorial/xtuner/llava/llava_internlm2_chat_1_8b_qlora_clip_vit_large_p14_336_lora_e1_gpu8_finetune_copy.py --deepspeed deepspeed_zero23.5. 对比Finetune前后的性能差异

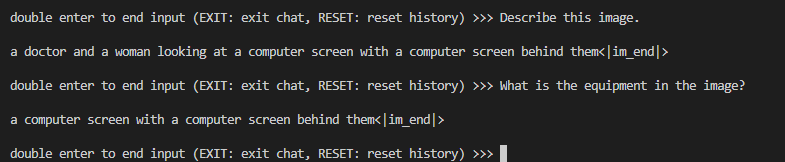

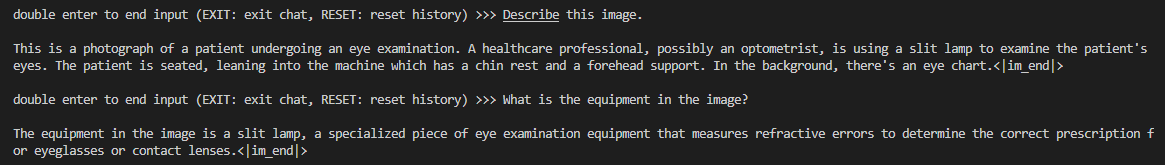

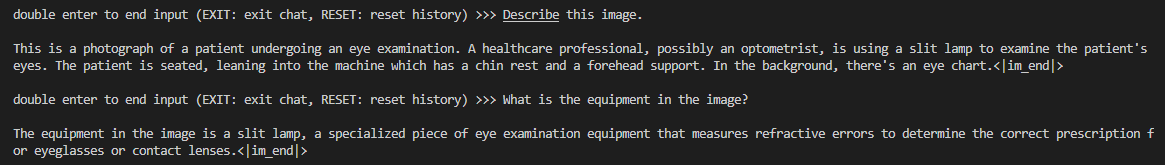

3.5.1. Finetune前

即:加载 1.8B 和 Pretrain阶段产物(iter_2181) 到显存。

# 解决小bug

export MKL_SERVICE_FORCE_INTEL=1

export MKL_THREADING_LAYER=GNU

# pth转huggingface

xtuner convert pth_to_hf \

llava_internlm2_chat_1_8b_clip_vit_large_p14_336_e1_gpu8_pretrain \

/root/share/new_models/xtuner/iter_2181.pth \

/root/tutorial/xtuner/llava/llava_data/iter_2181_hf

# 启动!

xtuner chat /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b \

--visual-encoder /root/share/new_models/openai/clip-vit-large-patch14-336 \

--llava /root/tutorial/xtuner/llava/llava_data/iter_2181_hf \

--prompt-template internlm2_chat \

--image /root/tutorial/xtuner/llava/llava_data/test_img/oph.jpgQ1: Describe this image.

Q2: What is the equipment in the image?

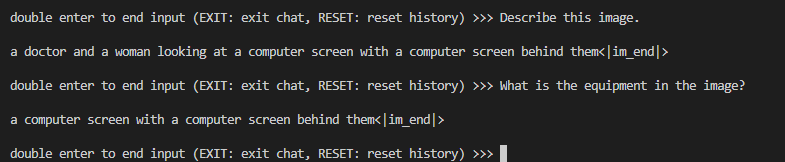

1.3.5.2. Finetune后

即:加载 1.8B 和 Fintune阶段产物 到显存。

# 解决小bug

export MKL_SERVICE_FORCE_INTEL=1

export MKL_THREADING_LAYER=GNU

# pth转huggingface

xtuner convert pth_to_hf \

/root/tutorial/xtuner/llava/llava_internlm2_chat_1_8b_qlora_clip_vit_large_p14_336_lora_e1_gpu8_finetune_copy.py \

/root/tutorial/xtuner/llava/work_dirs/llava_internlm2_chat_1_8b_qlora_clip_vit_large_p14_336_lora_e1_gpu8_finetune_copy/iter_1200.pth \

/root/tutorial/xtuner/llava/llava_data/iter_1200_hf

# 启动!

xtuner chat /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b \

--visual-encoder /root/share/new_models/openai/clip-vit-large-patch14-336 \

--llava /root/tutorial/xtuner/llava/llava_data/iter_1200_hf \

--prompt-template internlm2_chat \

--image /root/tutorial/xtuner/llava/llava_data/test_img/oph.jpgQ1: Describe this image.

Q2: What is the equipment in the image?

1.3.5.2. Finetune后

即:加载 1.8B 和 Fintune阶段产物 到显存。

# 解决小bug

export MKL_SERVICE_FORCE_INTEL=1

export MKL_THREADING_LAYER=GNU

# pth转huggingface

xtuner convert pth_to_hf \

/root/tutorial/xtuner/llava/llava_internlm2_chat_1_8b_qlora_clip_vit_large_p14_336_lora_e1_gpu8_finetune_copy.py \

/root/tutorial/xtuner/llava/work_dirs/llava_internlm2_chat_1_8b_qlora_clip_vit_large_p14_336_lora_e1_gpu8_finetune_copy/iter_1200.pth \

/root/tutorial/xtuner/llava/llava_data/iter_1200_hf

# 启动!

xtuner chat /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b \

--visual-encoder /root/share/new_models/openai/clip-vit-large-patch14-336 \

--llava /root/tutorial/xtuner/llava/llava_data/iter_1200_hf \

--prompt-template internlm2_chat \

--image /root/tutorial/xtuner/llava/llava_data/test_img/oph.jpgQ1: Describe this image.

Q2: What is the equipment in the image?

Finetune前后效果对比:

Finetune前:只会打标题

Finetune后:会回答问题了

三, 第 4 节课作业

记录复现过程并截图

基础作业(结营必做)

- 训练自己的小助手认知(记录复现过程并截图)----上文已记录,跳过

进阶作业

-

将自我认知的模型上传到 OpenXLab,并将应用部署到 OpenXLab(优秀学员必做)

-

复现多模态微调(优秀学员必做)----上文已记录,跳过

将自我认知的模型上传到 OpenXLab,并将应用部署到 OpenXLab

因只有cpu配置权限,未能完成,待开通gpu权限后更新

参考:https://github.com/InternLM/Tutorial/tree/camp2/tools/openxlab-deploy

首先安装git(intern studio的镜像中默认已安装git,但需要补充安装git lfs)

# install git

sudo apt-get update

sudo apt-get install git

# install git lfs

sudo apt-get update

sudo apt-get install git-lfs登录OpenXLab 平台,查看Git的用户名

OpenXLab 使用你在平台的用户名作为 Git的用户名,具体获取路径,可登录 OpenXLab 后,点击个人头像下的 【账号与安全】查看个人的用户名

配置 Git Username,用于作为 Git 提交的身份标识。

git config --global user.name "Username"需要将 Username 替换成你在 OpenXLab 平台上的用户名

配置 Git Email

git config --global user.email "[email protected]"2.2.2 拉取模型仓库

首先需要在 OpenXLab 先创建一个空仓库,填写模型仓库的基本信息,包括仓库名称、任务类型、访问权限等。

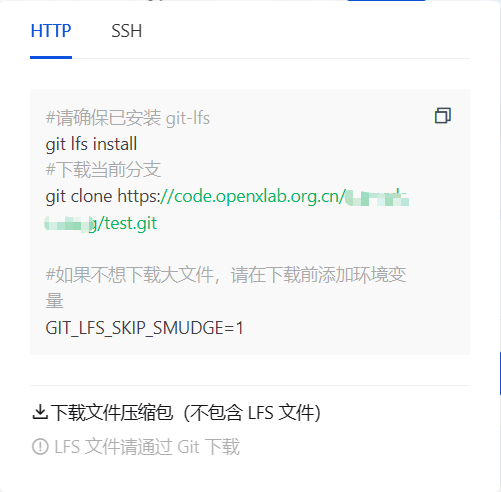

创建完成空的模型仓库后,找到该仓库的 git 地址并拉取该空仓库至本地,空仓库的地址在模型文件的下载按钮下,如下所示

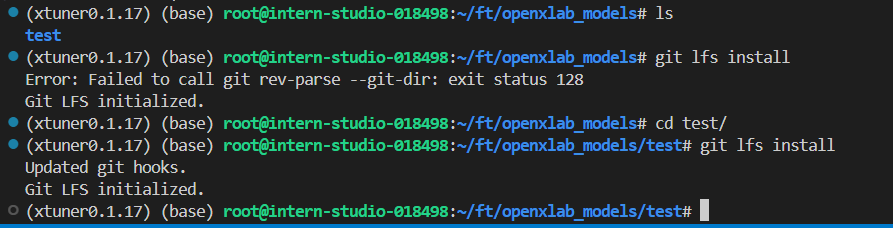

官网的描述有些问题,安装 git-lfs需要确保在一个用于git托管的目录下才能安装,这里我们先clone下来代码

#创建一个路径存放一会的仓库,并进入

mkdir /root/ft/openxlab_models

cd /root/ft/openxlab_models

#复制下载指令到shell中执行,这里项目名以test为例

git clone https://code.openxlab.org.cn/用户名/test.git

cd test

#安装git lfs

git lfs install

2.2.3配置Token和密钥

2.2.3.1 获取 Git Access Token

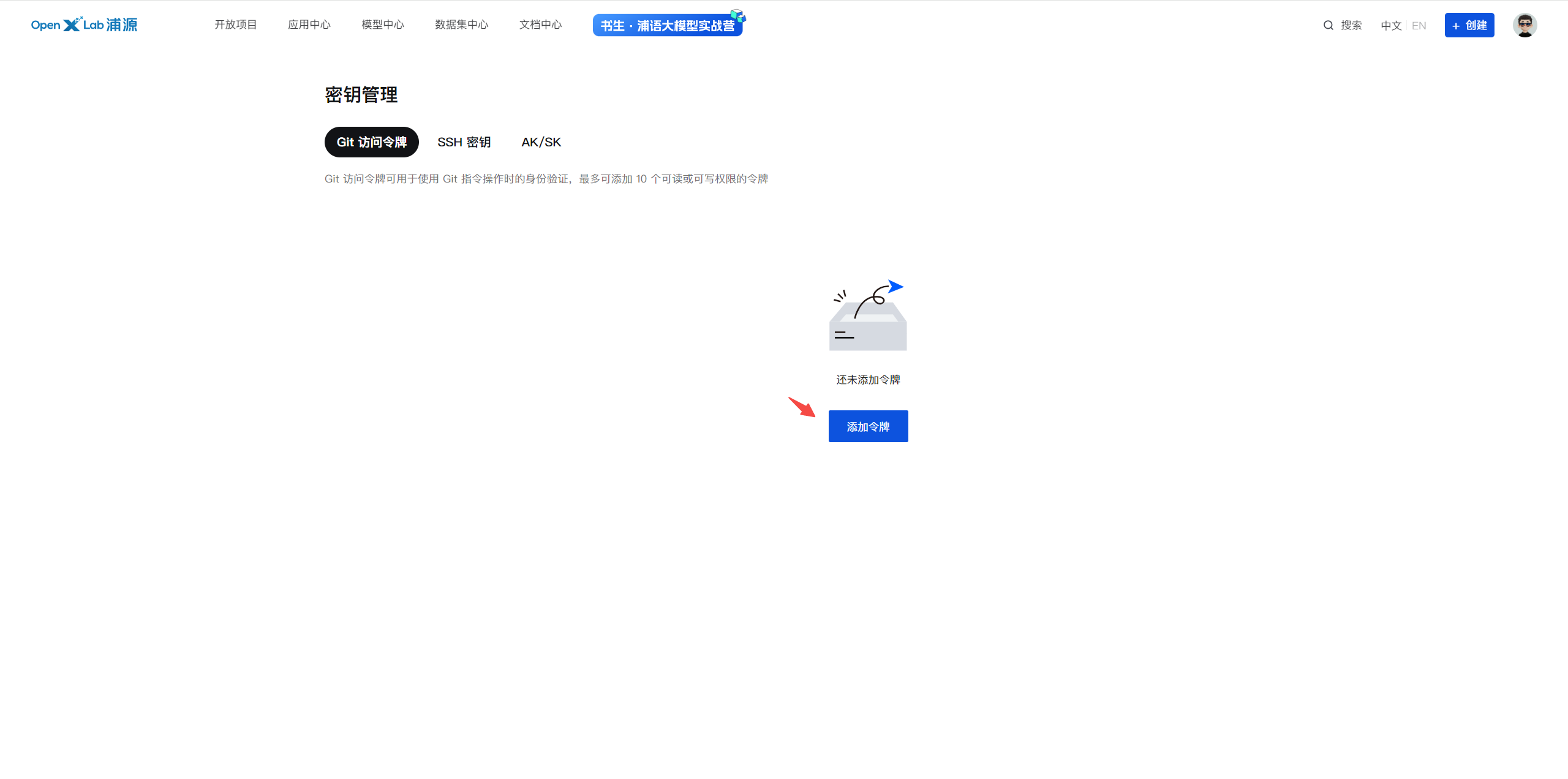

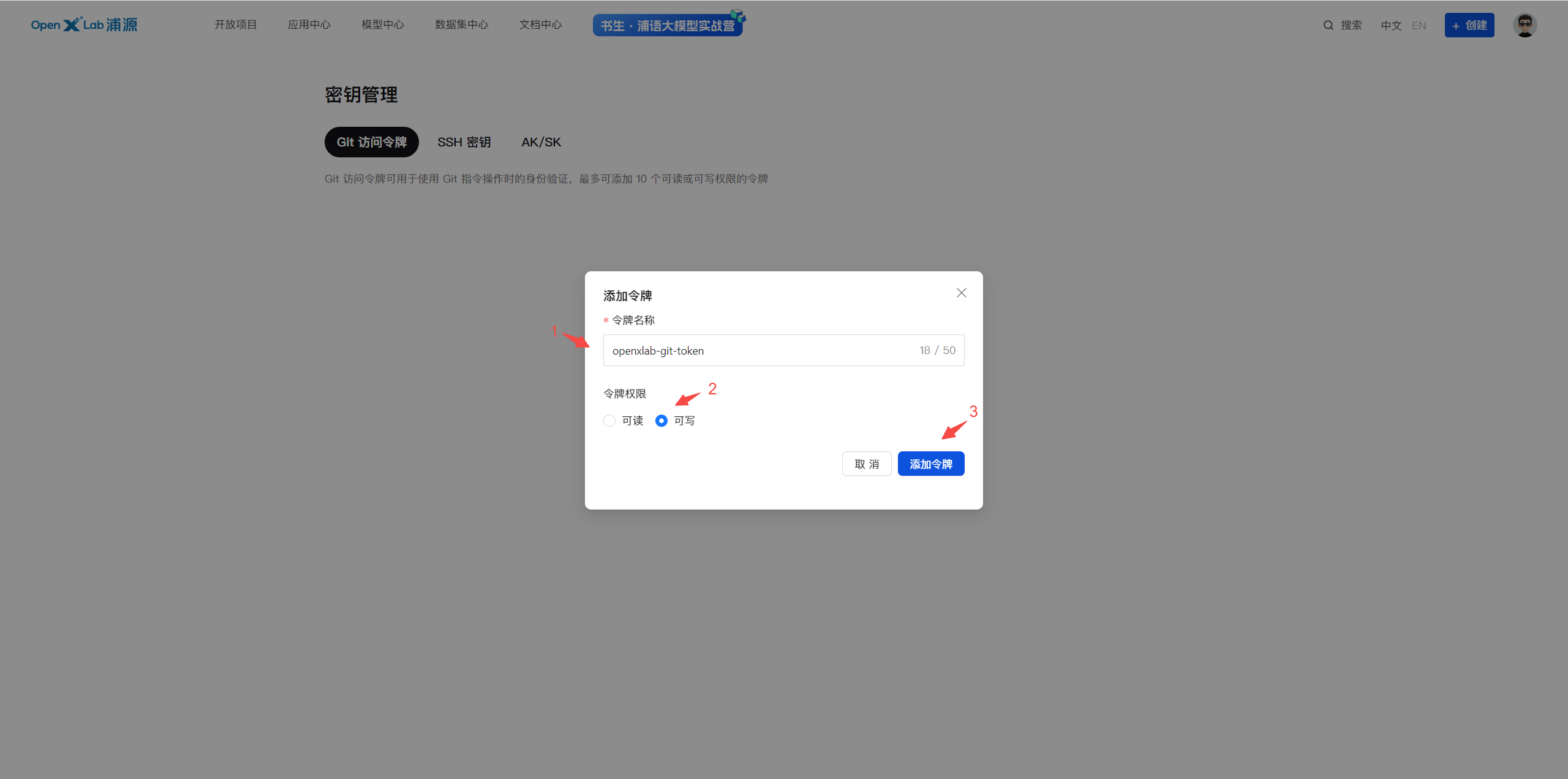

在 OpenXLab 的密钥管理添加 Git 令牌,步骤如下

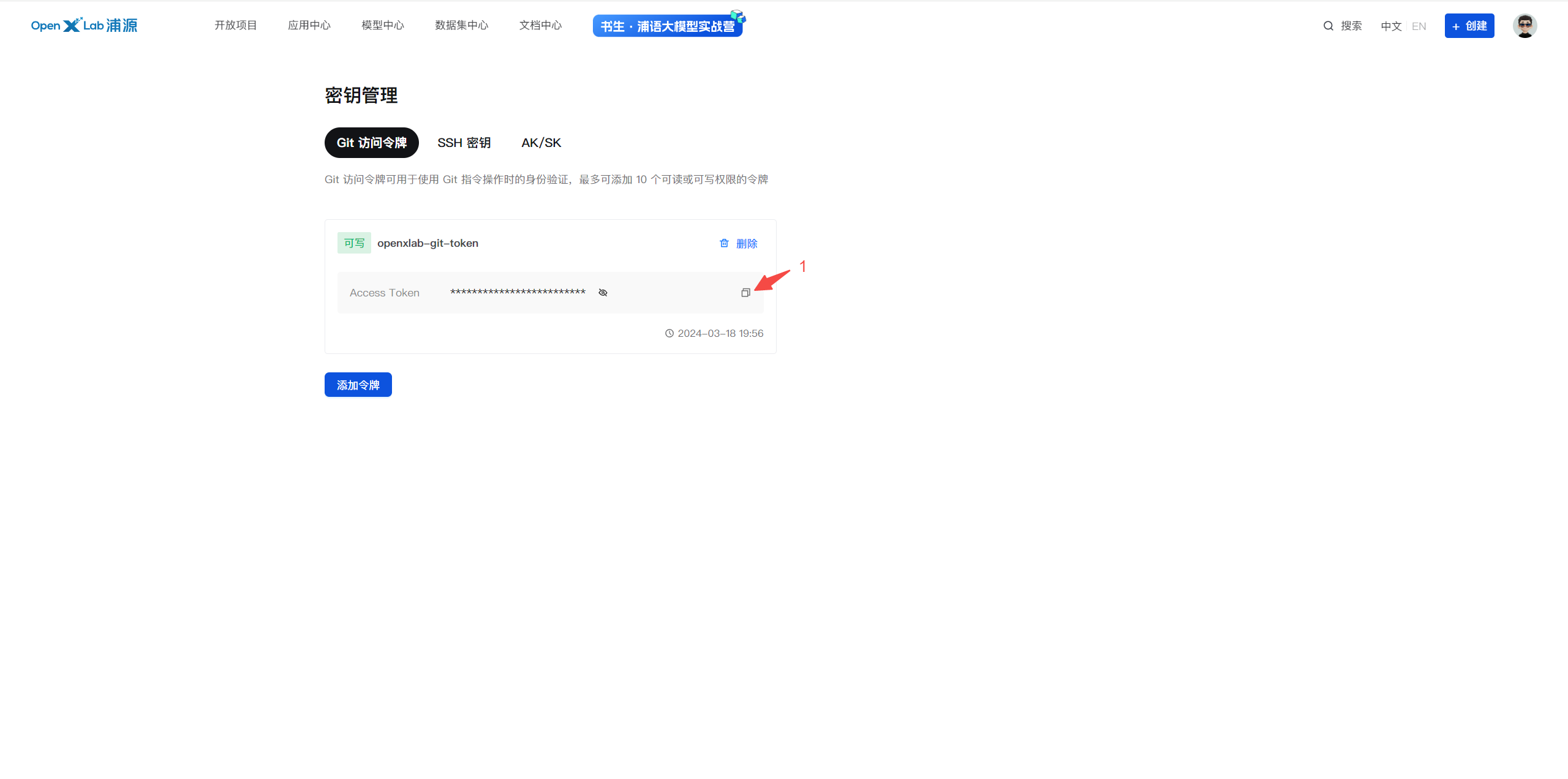

进入密钥管理页面,点击添加令牌,输入一个令牌名称和选择可写的权限,如下图所示

添加完令牌后,记得复制生成的 Access Token,如下图所示,在后续上传模型文件,执行git push 命令时会需要填入 Username 和 Access Token 信息

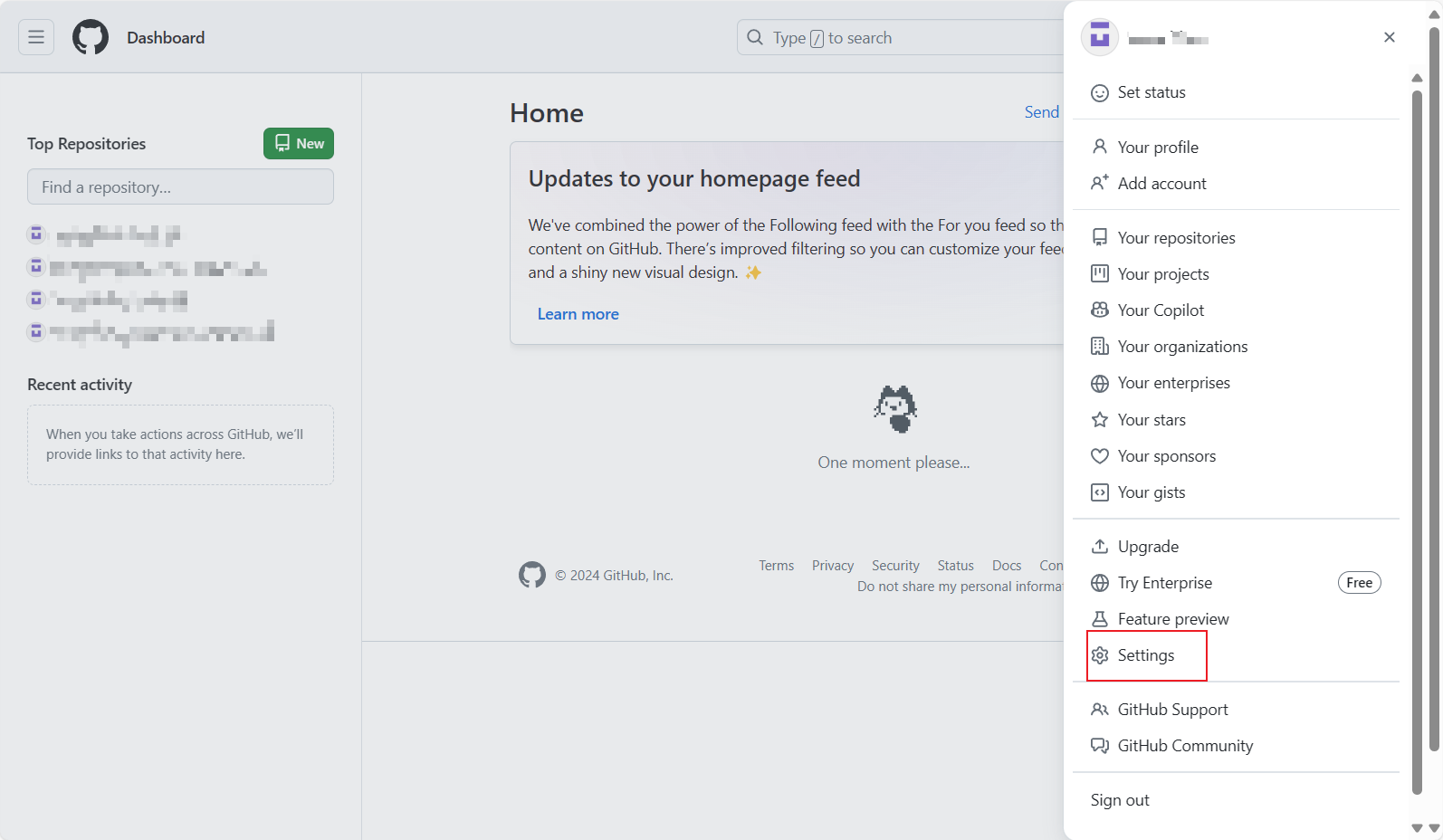

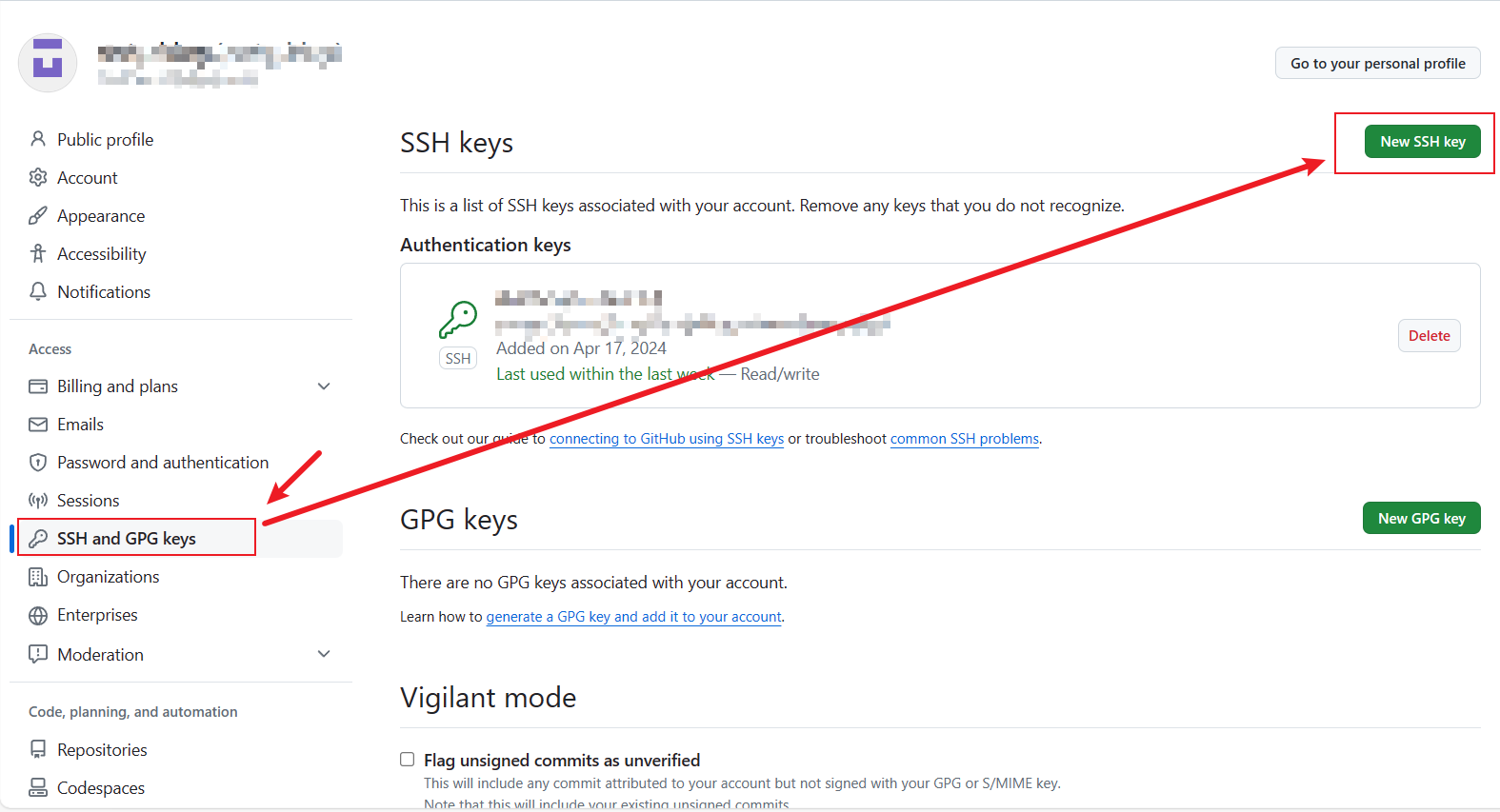

2.2.3.2 添加SSH 密钥(github)

后续我们还需要在github上创建仓库,故需要将ssh密钥添加到github

首先在机子上生成SSH 密钥

ssh-keygen弹出的几个输入参数默认回车,随后ssh密钥默认保存在/root/.ssh/id_rsa.pub

查看密钥

cat ~/.ssh/id_rsa.pub将输出的密钥内容复制保存

登录github,选择"设置"

将刚才保存的ssh key填写到key栏,title栏备注一个名字方便辨认,保存

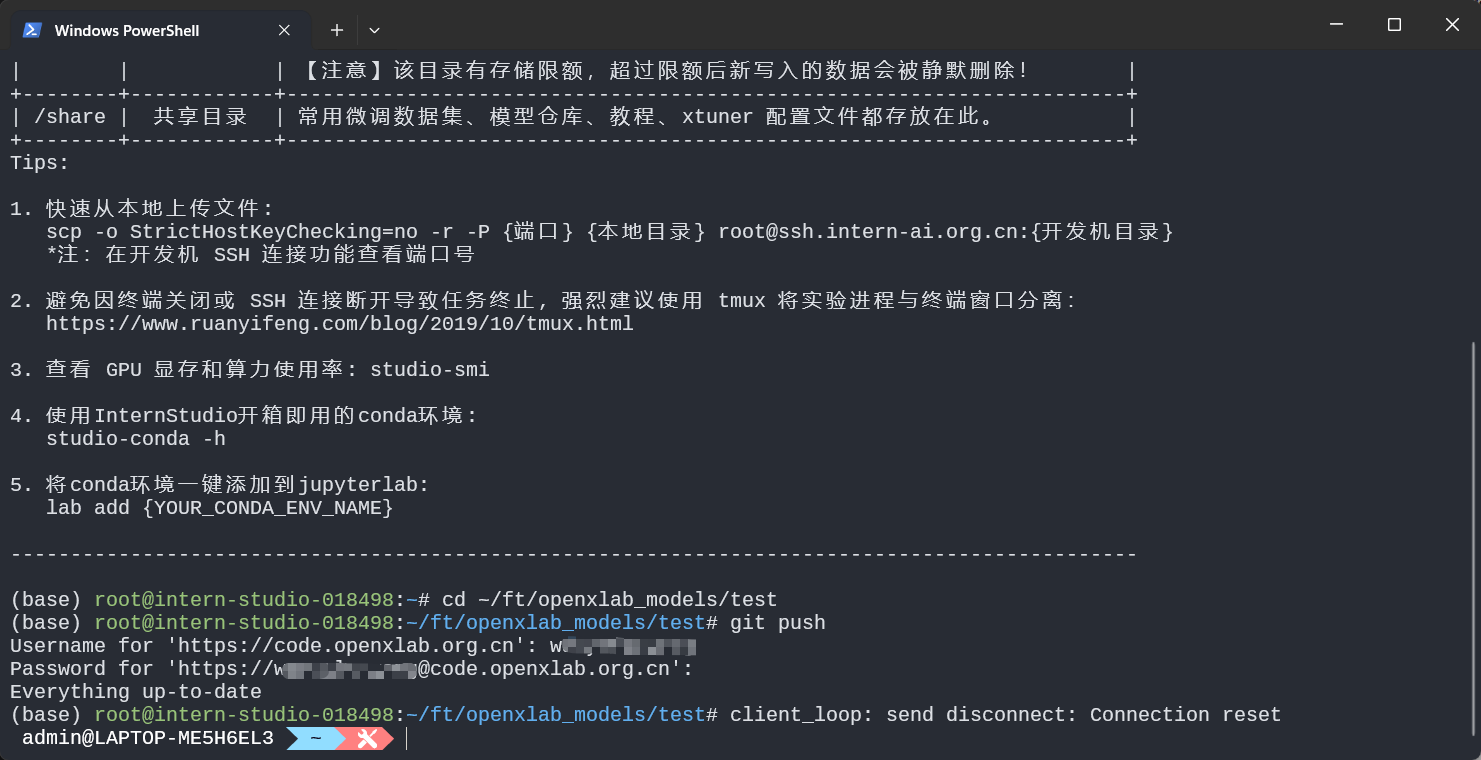

2.2.4 上传模型文件

在克隆的仓库目录中整理模型文件,即将我们之前训练的模型文件放入至clone的目录中,并执行git push命令将模型推送至远程仓库(这里我把之前训练融合后的模型,即/root/ft/final_model下的模型文件,复制到刚才的仓库目录下,即/root/ft/openxlab_models/test)

cp /root/ft/final_model/* /root/ft/openxlab_models/test/本地 clone 的文档目录结构如下所示:

在执行 git push 之前,如果您的仓库中包含大型文件,并且您希望使用 Git LFS 来管理这些文件,您需要先标记这些文件以便 Git LFS 能够识别它们。这通常是通过使用 git lfs track 命令来标记。以下是使用 git lfs track 命令的基本步骤:

LFS管理大文件:使用 git lfs track 命令来标记你希望通过 Git LFS 管理的大文件。例如,您想要通过LFS管理所有的 .bin和 .model的模型文件,可以使用以下命令:

git lfs track "*.bin"

git lfs track "*.model"标记LFS管理的文件后,提交更新的信息,执行 git push 上传模型,命令如下所示:

git add -A

git commit -m "upload model"

git push命令行解释

git add -A:添加所有新文件、修改过的文件和删除的文件到暂存区。git commit -m "upload model":创建一个新的提交,附带提交信息"upload model"。git push:将本地的提交推送到远程仓库。

PS:可能出现的问题

在vscode中的终端上直接git push,可能会出现以下报错:

Missing or invalid credentials.

Error: connect ECONNREFUSED /tmp/vscode-git-bd5db62d8b.sock

at PipeConnectWrap.afterConnect [as oncomplete] (node:net:1555:16) {

errno: -111,

code: 'ECONNREFUSED',

syscall: 'connect',

address: '/tmp/vscode-git-bd5db62d8b.sock'

}

Missing or invalid credentials.

Error: connect ECONNREFUSED /tmp/vscode-git-bd5db62d8b.sock

at PipeConnectWrap.afterConnect [as oncomplete] (node:net:1555:16) {

errno: -111,

code: 'ECONNREFUSED',

syscall: 'connect',

address: '/tmp/vscode-git-bd5db62d8b.sock'

}

remote: Unauthorized可以尝试使用cmd终端远程ssh后git push

在执行 git push 时会弹出身份验证的弹窗,填入 Username 和 Access Token 信息,如图所示

2.3 编写代码

本小节为编写 chat 的 web-ui 代码,主要包括项目结构初始化、应用环境配置和 gradio 应用代码的编写

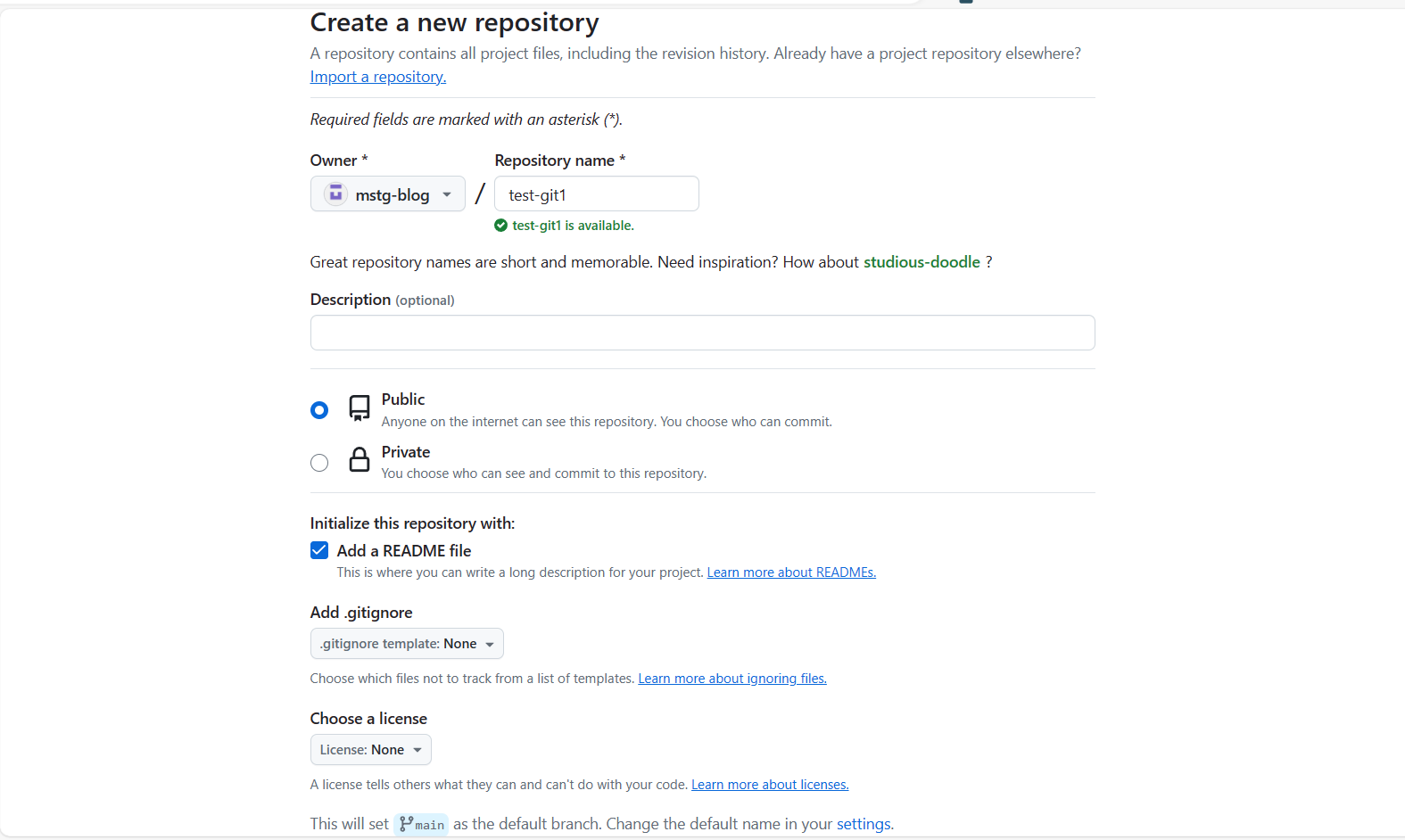

2.3.1 初始化项目结构

创建一个新的 GitHub 仓库来存放您的 gradio 应用代码。例如创建一个 test-git 的代码仓库

为了方便直接clone,创建时选中添加说明文件

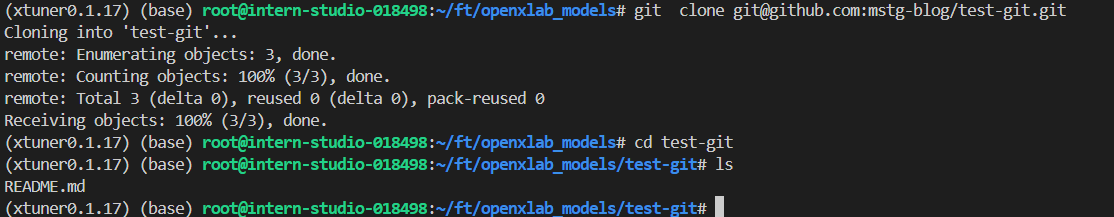

随后在机子上clone下来仓库

#git clone [email protected]:用户名/仓库名.git,以我的仓库为例

git clone [email protected]:mstg-blog/test-git.git

cd test-git

参考官方教程推荐的项目结构如下:

├─GitHub_Repo_Name

│ ├─app.py # Gradio 应用默认启动文件为app.py,应用代码相关的文件包含模型推理,应用的前端配置代码

│ ├─requirements.txt # 安装运行所需要的 Python 库依赖(pip 安装)

│ ├─packages.txt # 安装运行所需要的 Debian 依赖项( apt-get 安装)

| ├─README.md # 编写应用相关的介绍性的文档

│ └─... 于是创建所需要的文件:

cd /root/ft/openxlab_models/test-git

touch app.py requirements.txt packages.txt

2.3.2 应用环境配置

依赖管理:配置应用所需的运行环境,如有 Python 依赖项( pip 安装)可写入 requirements.txt 中

cd /root/ft/openxlab_models/test-git

echo 'gradio==4.10.0

transformers

sentencepiece

einops

accelerate

tiktoken' > requirements.txtpackages.txt 配置下载模型权重的工具包 git 和 git-lfs

echo 'git

git-lfs' >packages.txt2.3.3 编写 gradio 应用代码

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

plt.rcParams['figure.figsize'] = (10, 6) # 设置输出图片大小编写一个app.py文件,里面可以通过transformers框架进行模型实例化并通过gradio组件搭建chat聊天界面,本次代码都存放在 GitHub示例代码仓库中,如需查看详细代码编写,可浏览 https://github.com/keyhsw/internlm2-chat-7b-git

import gradio as gr

import os

import torch

from transformers import AutoModelForCausalLM, AutoTokenizer, AutoModel

# download internlm2 to the base_path directory using git tool

base_path = './internlm2-chat-7b'

os.system(f'git clone https://code.openxlab.org.cn/OpenLMLab/internlm2-chat-7b.git {base_path}')

os.system(f'cd {base_path} && git lfs pull')

tokenizer = AutoTokenizer.from_pretrained(base_path,trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(base_path,trust_remote_code=True, torch_dtype=torch.float16).cuda()

def chat(message,history):

for response,history in model.stream_chat(tokenizer,message,history,max_length=2048,top_p=0.7,temperature=1):

yield response

gr.ChatInterface(chat,

title="InternLM2-Chat-7B",

description="""

InternLM is mainly developed by Shanghai AI Laboratory.

""",

).queue(1).launch()

Comments 1 条评论