1 趣味 Demo 任务列表

本节课可以让同学们实践 4 个主要内容,分别是:

- 部署

InternLM2-Chat-1.8B模型进行智能对话 - 部署实战营优秀作品

八戒-Chat-1.8B模型 - 通过

InternLM2-Chat-7B运行Lagent智能体Demo - 实践部署

浦语·灵笔2模型

2 部署 InternLM2-Chat-1.8B 模型进行智能对话

2.1配置环境

进入开发机后,在 terminal 中输入环境配置命令 (配置环境时间较长,需耐心等待):

studio-conda -o internlm-base -t demo

# 与 studio-conda 等效的配置方案

# conda create -n demo python==3.10 -y

# conda activate demo

# conda install pytorch==2.0.1 torchvision==0.15.2 torchaudio==2.0.2 pytorch-cuda=11.7 -c pytorch -c nvidia配置完成后,进入到新创建的 conda 环境之中:

conda activate demo输入以下命令,完成环境包的安装:

pip install huggingface-hub==0.17.3

pip install transformers==4.34

pip install psutil==5.9.8

pip install accelerate==0.24.1

pip install streamlit==1.32.2

pip install matplotlib==3.8.3

pip install modelscope==1.9.5

pip install sentencepiece==0.1.992.2 下载 InternLM2-Chat-1.8B 模型

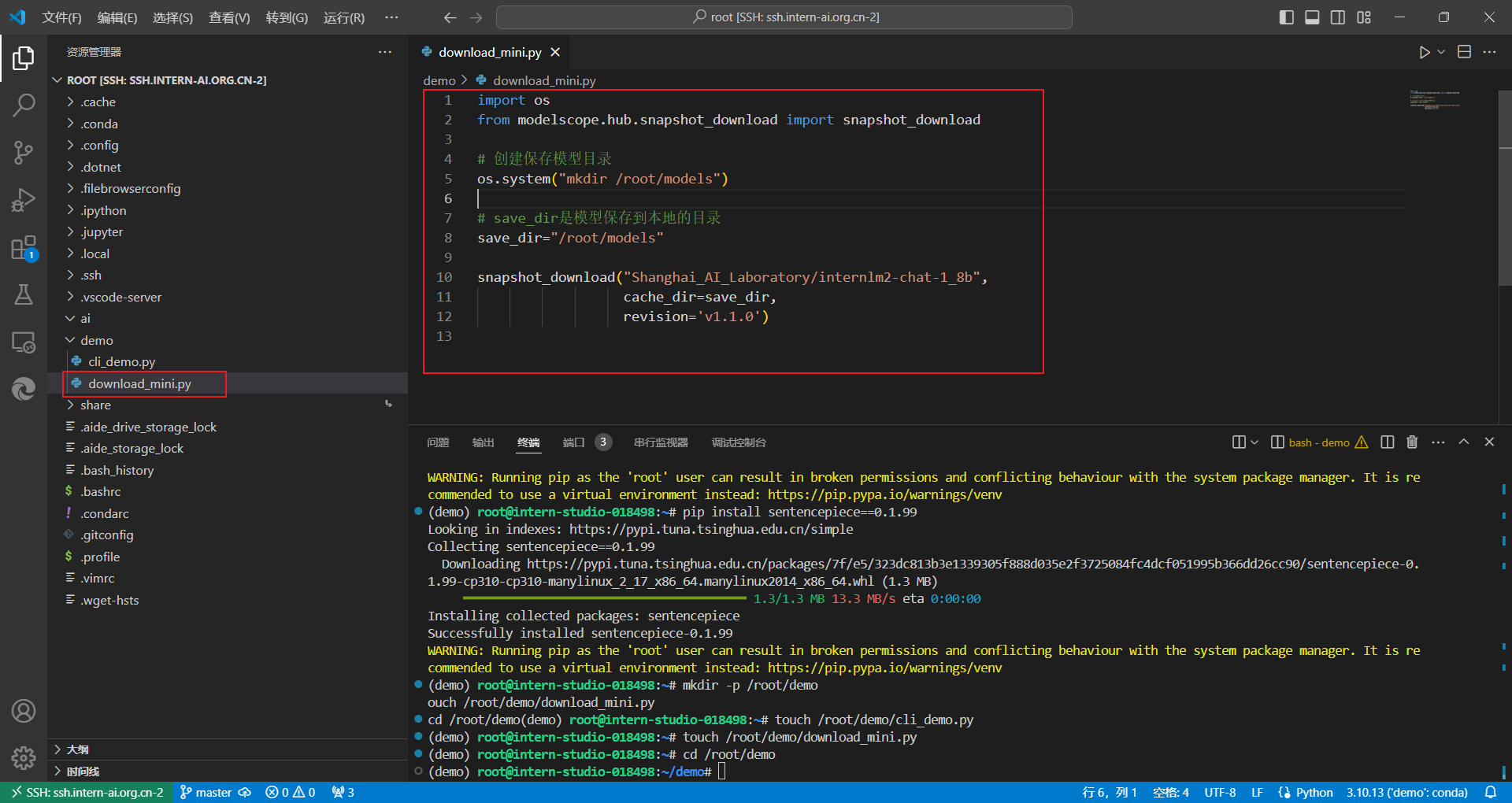

按路径创建文件夹,并进入到对应文件目录中:

mkdir -p /root/demo

touch /root/demo/cli_demo.py

touch /root/demo/download_mini.py

cd /root/demo通过左侧文件夹栏目,双击进入 demo 文件夹。

双击打开 /root/demo/download_mini.py 文件,复制以下代码:

import os

from modelscope.hub.snapshot_download import snapshot_download

# 创建保存模型目录

os.system("mkdir /root/models")

# save_dir是模型保存到本地的目录

save_dir="/root/models"

snapshot_download("Shanghai_AI_Laboratory/internlm2-chat-1_8b",

cache_dir=save_dir,

revision='v1.1.0')执行命令,下载模型参数文件:

python /root/demo/download_mini.pyPS:这里额外介绍一下snapshot_download方法是什么?

huggingface 官方提供了snapshot_download 方法下载完整模型,参数众多、比较完善。支持断点续传、多线程、指定路径、配置代理、排除特定文件等功能。然而有两个缺点:

- 1))该方法依赖于 transformers 库,而这个库是个开发用的库,对于自动化运维有点重;

- 2) 该方法调用比较复杂,参数较多,例如默认会检查用户缓存目录下是否已有对应模型,如已有则会创建符号链接,不理解的容易导致问题。外加需要配置代理。常见参数配置如下:

from huggingface_hub import snapshot_download

snapshot_download(

repo_id="bigscience/bloom-560m",

local_dir="/data/user/test",

proxies={"https": "http://localhost:7890"},

max_workers=8

)对于需要登录的模型,还需要两行额外代码:

import huggingface_hub

huggingface_hub.login("HF_TOKEN") # token 从 https://huggingface.co/settings/tokens 获取2.3 运行 cli_demo

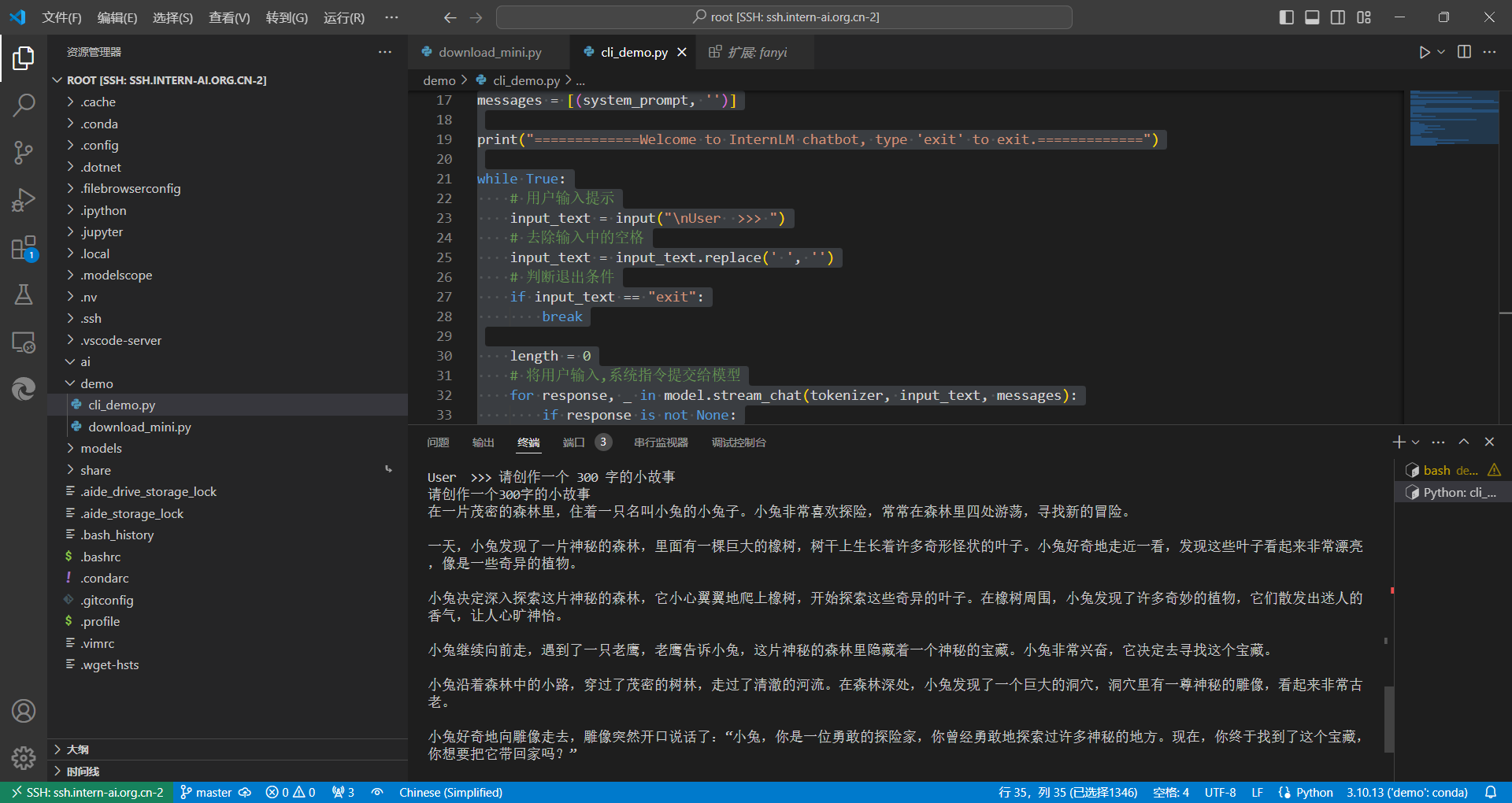

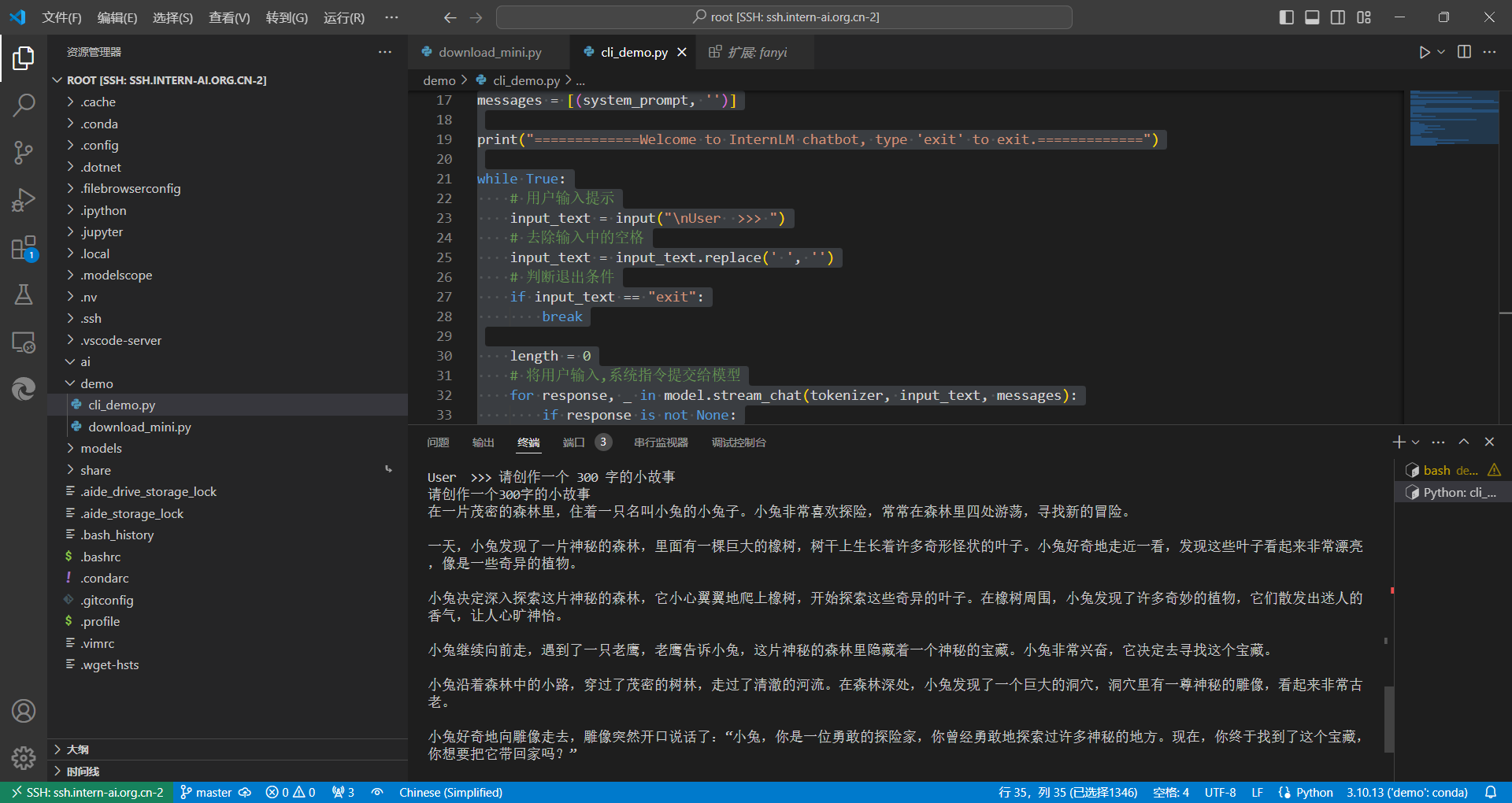

双击打开 /root/demo/cli_demo.py 文件,复制以下代码(添加了部分注释):

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM

# 模型路径

model_name_or_path = "/root/models/Shanghai_AI_Laboratory/internlm2-chat-1_8b"

tokenizer = AutoTokenizer.from_pretrained(model_name_or_path, trust_remote_code=True, device_map='cuda:0')

model = AutoModelForCausalLM.from_pretrained(model_name_or_path, trust_remote_code=True, torch_dtype=torch.bfloat16, device_map='cuda:0')

model = model.eval()

# 初始设置系统指令

system_prompt = """You are an AI assistant whose name is InternLM (书生·浦语).

- InternLM (书生·浦语) is a conversational language model that is developed by Shanghai AI Laboratory (上海人工智能实验室). It is designed to be helpful, honest, and harmless.

- InternLM (书生·浦语) can understand and communicate fluently in the language chosen by the user such as English and 中文.

"""

# 创建一个消息

messages = [(system_prompt, '')]

print("=============Welcome to InternLM chatbot, type 'exit' to exit.=============")

while True:

# 用户输入提示

input_text = input("\nUser >>> ")

# 去除输入中的空格

input_text = input_text.replace(' ', '')

# 判断退出条件

if input_text == "exit":

break

length = 0

# 将用户输入,系统指令提交给模型

for response, _ in model.stream_chat(tokenizer, input_text, messages):

if response is not None:

print(response[length:], flush=True, end="")

length = len(response)输入命令,执行 Demo 程序:

conda activate demo

python /root/demo/cli_demo.py等待模型加载完成,键入内容示例:

请创作一个 300 字的小故事

3 实战:部署实战营优秀作品 八戒-Chat-1.8B 模型

3.1 简单介绍 八戒-Chat-1.8B、Chat-嬛嬛-1.8B、Mini-Horo-巧耳(实战营优秀作品)

具体模型链接如下:

- 八戒-Chat-1.8B:https://www.modelscope.cn/models/JimmyMa99/BaJie-Chat-mini/summary

- Chat-嬛嬛-1.8B:https://openxlab.org.cn/models/detail/BYCJS/huanhuan-chat-internlm2-1_8b

- Mini-Horo-巧耳:https://openxlab.org.cn/models/detail/SaaRaaS/Horowag_Mini

3.2 配置基础环境

运行环境命令:

conda activate demo使用 git 命令来获得仓库内的 Demo 文件:

cd /root/

git clone https://gitee.com/InternLM/Tutorial -b camp2

# git clone https://github.com/InternLM/Tutorial -b camp2

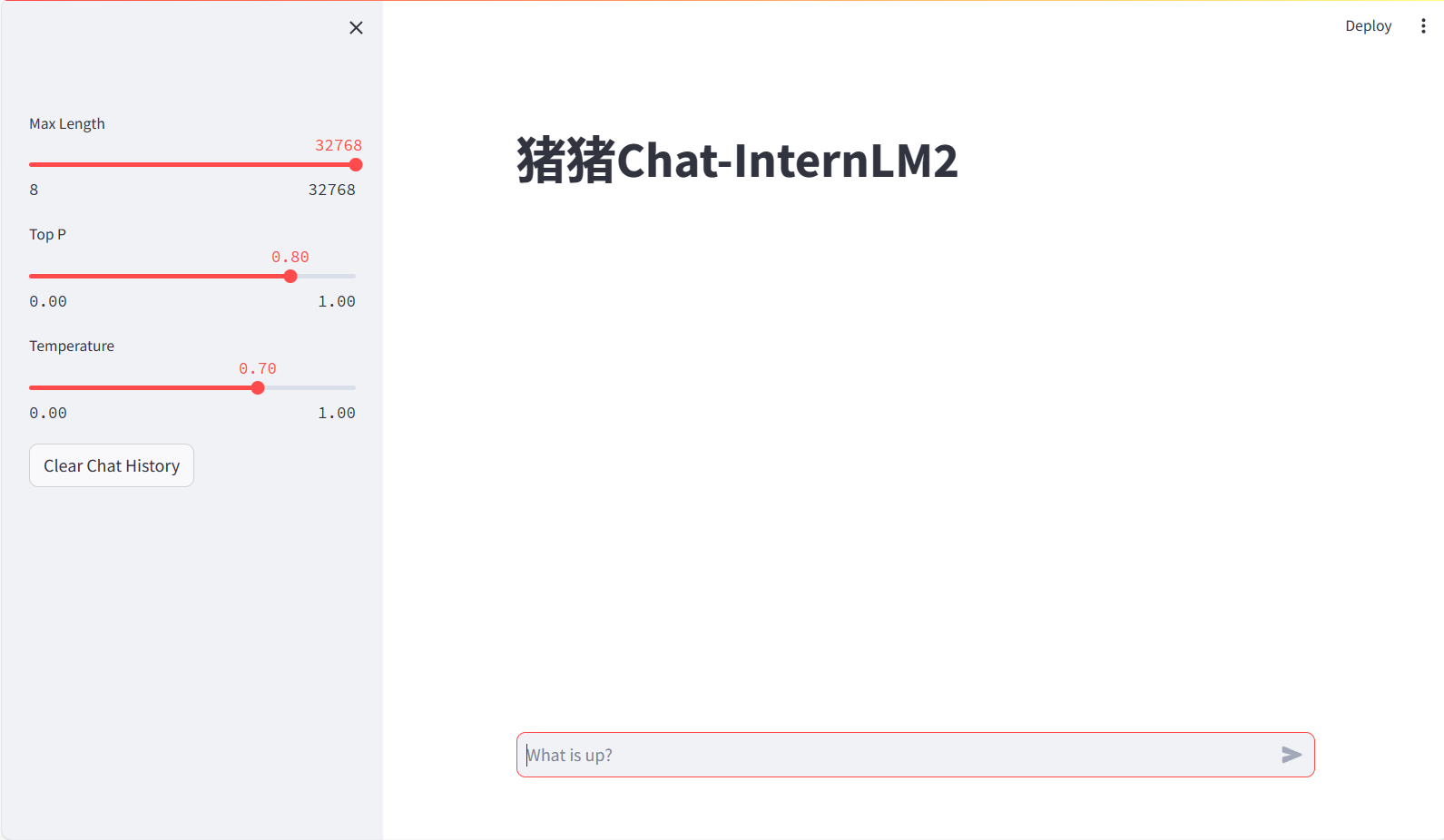

cd /root/Tutorial3.3 下载运行 Chat-八戒 Demo

执行 bajie_download.py:

python /root/Tutorial/helloworld/bajie_download.py待程序下载完成后,输入运行命令:

streamlit run /root/Tutorial/helloworld/bajie_chat.py --server.address 127.0.0.1 --server.port 6006我使用的vscode进行远程ssh连接,vscode会自动转发端口,这时直接浏览器访问http://127.0.0.1:6006/即可

4 实战:使用 Lagent 运行 InternLM2-Chat-7B 模型(开启 30% A100 权限后才可开启此章节)

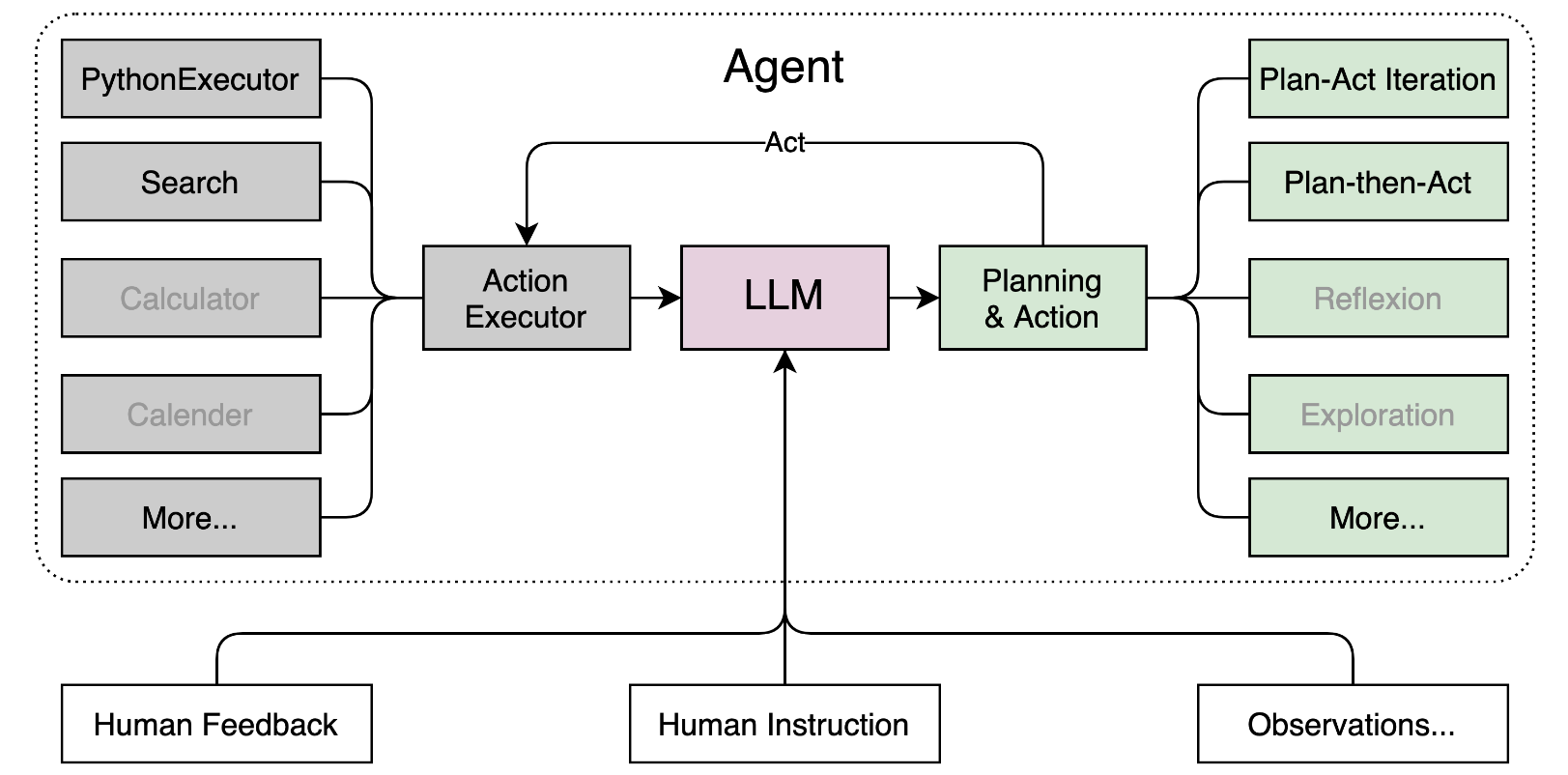

4.1 初步介绍 Lagent 相关知识

Lagent 是一个轻量级、开源的基于大语言模型的智能体(agent)框架,支持用户快速地将一个大语言模型转变为多种类型的智能体,并提供了一些典型工具为大语言模型赋能。它的整个框架图如下:

Lagent 的特性总结如下:

- 流式输出:提供 stream_chat 接口作流式输出,本地就能演示酷炫的流式 Demo。

- 接口统一,设计全面升级,提升拓展性,包括:

- Model : 不论是 OpenAI API, Transformers 还是推理加速框架 LMDeploy 一网打尽,模型切换可以游刃有余;

- Action: 简单的继承和装饰,即可打造自己个人的工具集,不论 InternLM 还是 GPT 均可适配;

- Agent:与 Model 的输入接口保持一致,模型到智能体的蜕变只需一步,便捷各种 agent 的探索实现;

- 文档全面升级,API 文档全覆盖。

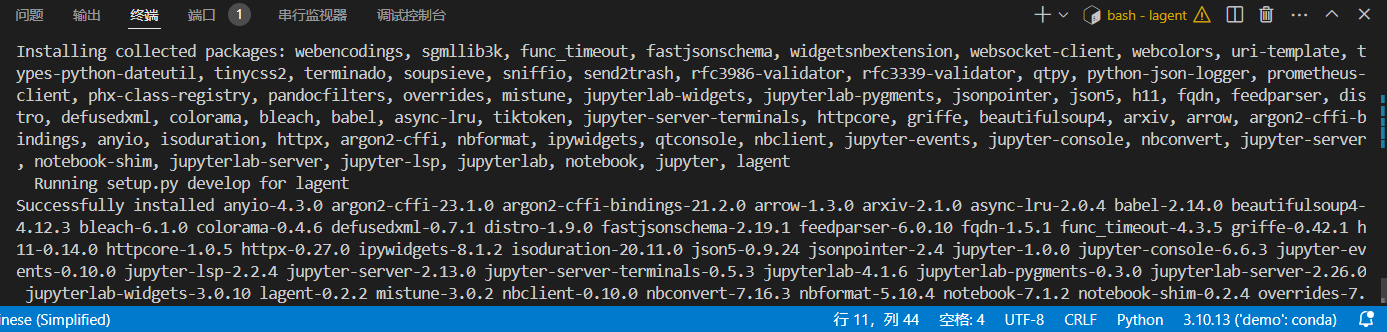

4.2 配置基础环境

开启 conda 环境:

conda activate demo打开文件子路径

cd /root/demo使用 git 命令下载 Lagent 相关的代码库:

git clone https://gitee.com/internlm/lagent.git

# git clone https://github.com/internlm/lagent.git

cd /root/demo/lagent

git checkout 581d9fb8987a5d9b72bb9ebd37a95efd47d479ac

pip install -e . # 源码安装

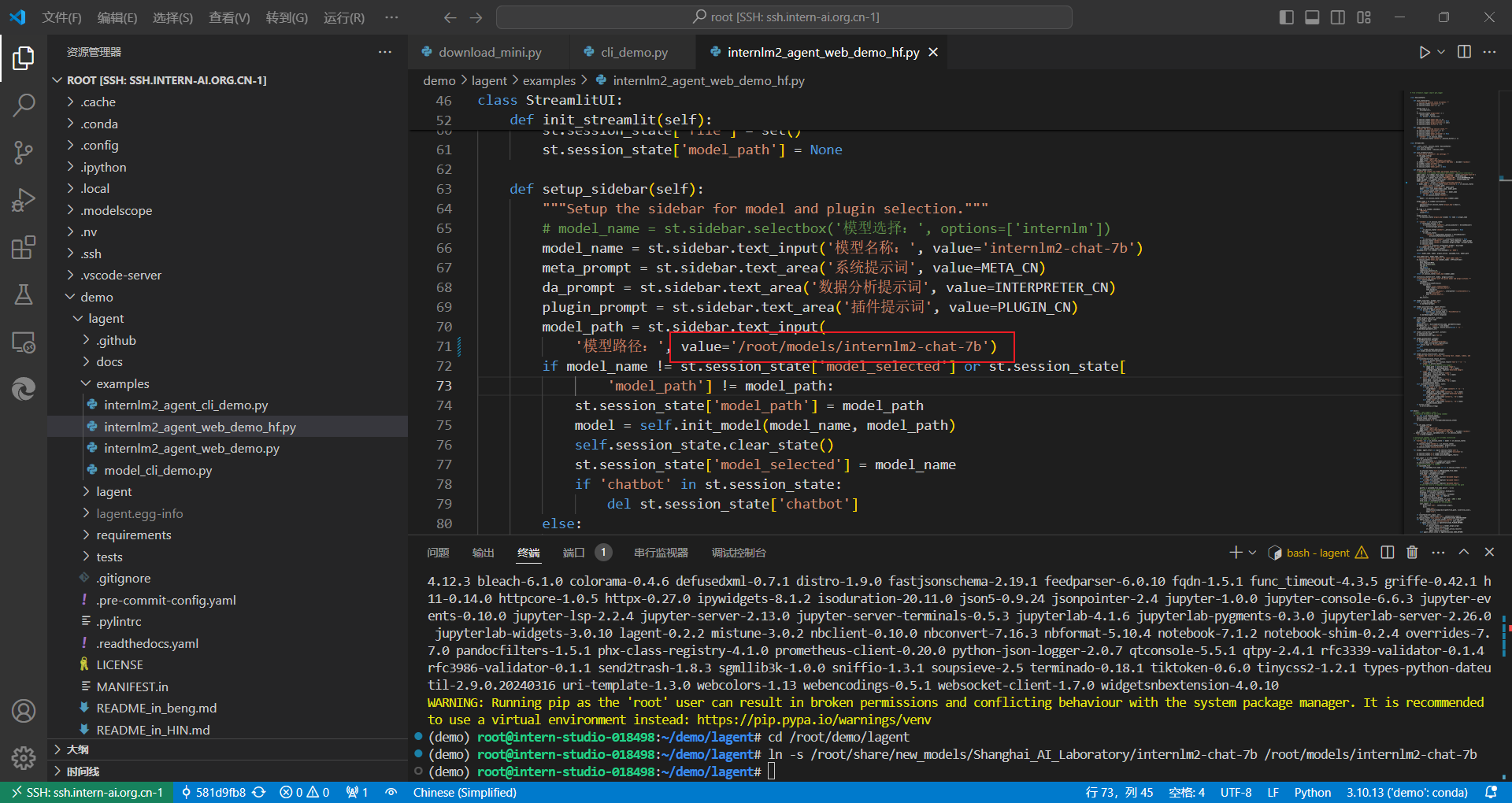

4.3 使用 Lagent 运行 InternLM2-Chat-7B 模型为内核的智能体

Intern Studio 在 ~/share 文件中预留了实践章节所需要的所有基础模型,包括 InternLM2-Chat-7b 、InternLM2-Chat-1.8b 等等。我们可以在后期任务中使用 share 文档中包含的资源,但是在本章节,为了能让大家了解各类平台使用方法,还是推荐同学们按照提示步骤进行实验。

打开 lagent 路径:

cd /root/demo/lagent在 terminal 中输入指令,构造软链接快捷访问方式:

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-7b /root/models/internlm2-chat-7b打开 /root/demo/lagent/examples/internlm2_agent_web_demo_hf.py 文件,并修改对应位置 (71行左右) 代码:

# 其他代码...

value='/root/models/internlm2-chat-7b'

# 其他代码...

输入运行命令 - 点开 6006 链接后,大约需要 5 分钟完成模型加载:

我使用的vscode进行远程ssh连接,vscode会自动转发端口,这时直接浏览器访问http://127.0.0.1:6006/即可

streamlit run /root/demo/lagent/examples/internlm2_agent_web_demo_hf.py --server.address 127.0.0.1 --server.port 6006打开 http://127.0.0.1:6006 后,(会有较长的加载时间)勾上数据分析,其他的选项不要选择,进行计算方面的 Demo 对话,即完成本章节实战。键入内容示例:

请解方程 2*X=1360 之中 X 的结果

5 实战:实践部署 浦语·灵笔2 模型(开启 50% A100 权限后才可开启此章节)

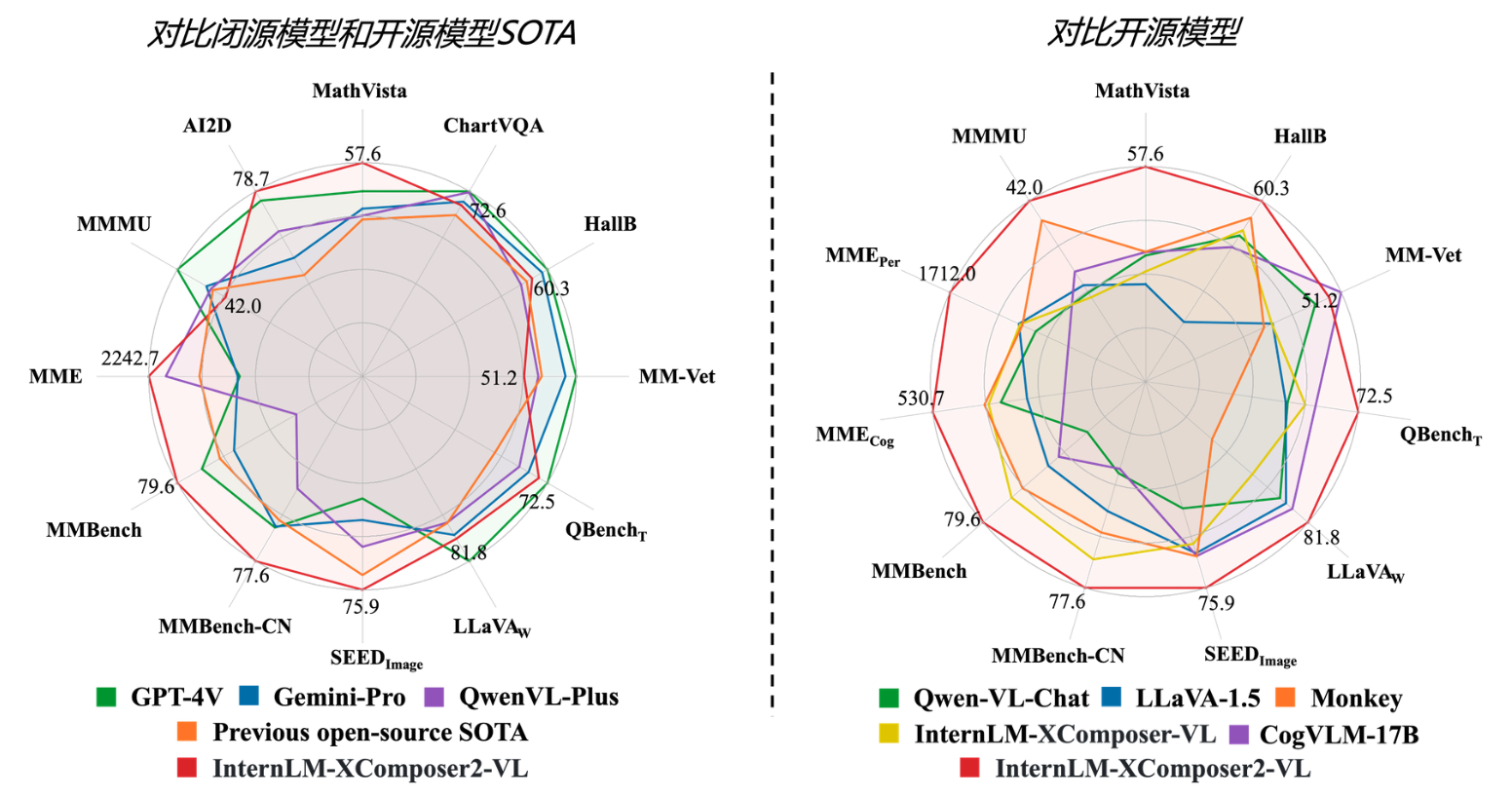

5.1 初步介绍 XComposer2 相关知识

浦语·灵笔2 是基于 书生·浦语2 大语言模型研发的突破性的图文多模态大模型,具有非凡的图文写作和图像理解能力,在多种应用场景表现出色,总结起来其具有:

- 自由指令输入的图文写作能力:

浦语·灵笔2可以理解自由形式的图文指令输入,包括大纲、文章细节要求、参考图片等,为用户打造图文并貌的专属文章。生成的文章文采斐然,图文相得益彰,提供沉浸式的阅读体验。 - 准确的图文问题解答能力:

浦语·灵笔2具有海量图文知识,可以准确的回复各种图文问答难题,在识别、感知、细节描述、视觉推理等能力上表现惊人。 - 杰出的综合能力:

浦语·灵笔2-7B基于书生·浦语2-7B模型,在13项多模态评测中大幅领先同量级多模态模型,在其中6项评测中超过GPT-4V和Gemini Pro。

5.2 配置基础环境

进入开发机,启动 conda 环境:

conda activate demo

# 补充环境包

pip install timm==0.4.12 sentencepiece==0.1.99 markdown2==2.4.10 xlsxwriter==3.1.2 gradio==4.13.0 modelscope==1.9.5PS:我尝试上面补充环境包,提示huggingface-hub包版本冲突,调整包版本也没有解决,于是重新创建了一个dome1环境,并根据下面方式补充包

conda create -n demo1 python==3.10 -y

conda activate demo1

conda install pytorch==2.0.1 torchvision==0.15.2 torchaudio==2.0.2 pytorch-cuda=11.7 -c pytorch -c nvidia

pip install accelerate==0.24.1

pip install timm==0.4.12 sentencepiece==0.1.99 markdown2==2.4.10 xlsxwriter==3.1.2 gradio==4.13.0 modelscope==1.9.5下载 InternLM-XComposer 仓库 相关的代码资源:

cd /root/demo

git clone https://gitee.com/internlm/InternLM-XComposer.git

# git clone https://github.com/internlm/InternLM-XComposer.git

cd /root/demo/InternLM-XComposer

git checkout f31220eddca2cf6246ee2ddf8e375a40457ff626在 terminal 中输入指令,构造软链接快捷访问方式:

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm-xcomposer2-7b /root/models/internlm-xcomposer2-7b

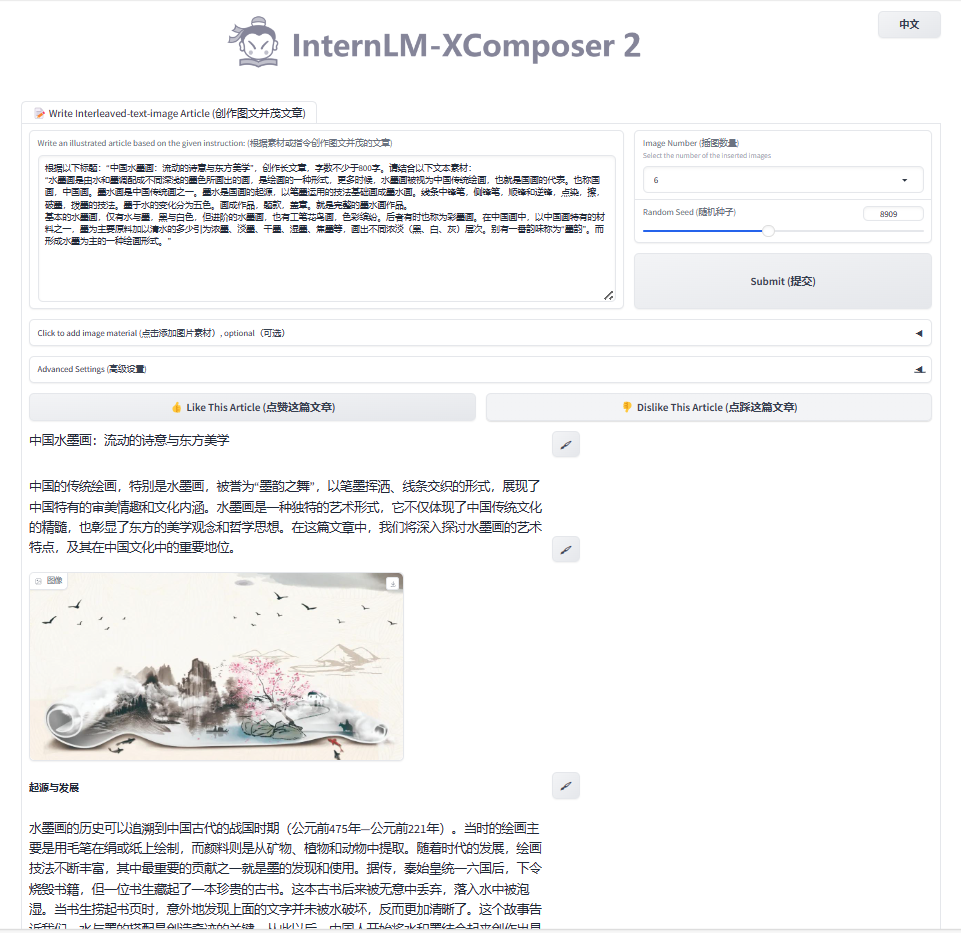

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm-xcomposer2-vl-7b /root/models/internlm-xcomposer2-vl-7b5.3 图文写作实战(开启 50% A100 权限后才可开启此章节)

继续输入指令,用于启动 InternLM-XComposer:

cd /root/demo/InternLM-XComposer

python /root/demo/InternLM-XComposer/examples/gradio_demo_composition.py \

--code_path /root/models/internlm-xcomposer2-7b \

--private \

--num_gpus 1 \

--port 6006我使用的vscode进行远程ssh连接,vscode会自动转发端口,这时直接浏览器访问http://127.0.0.1:6006/即可

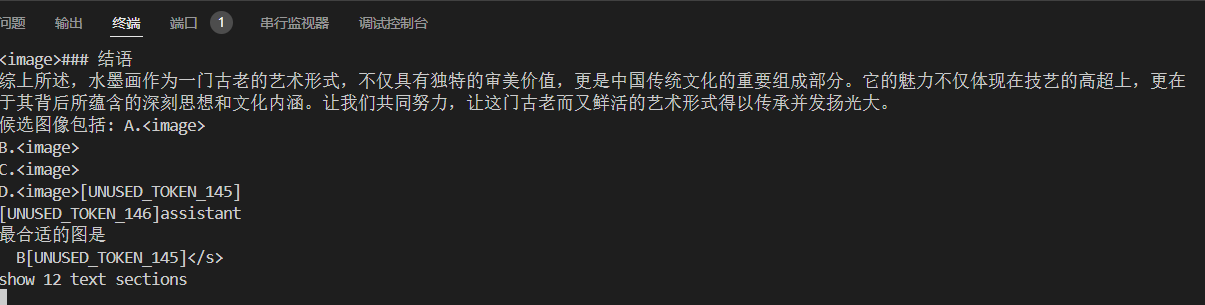

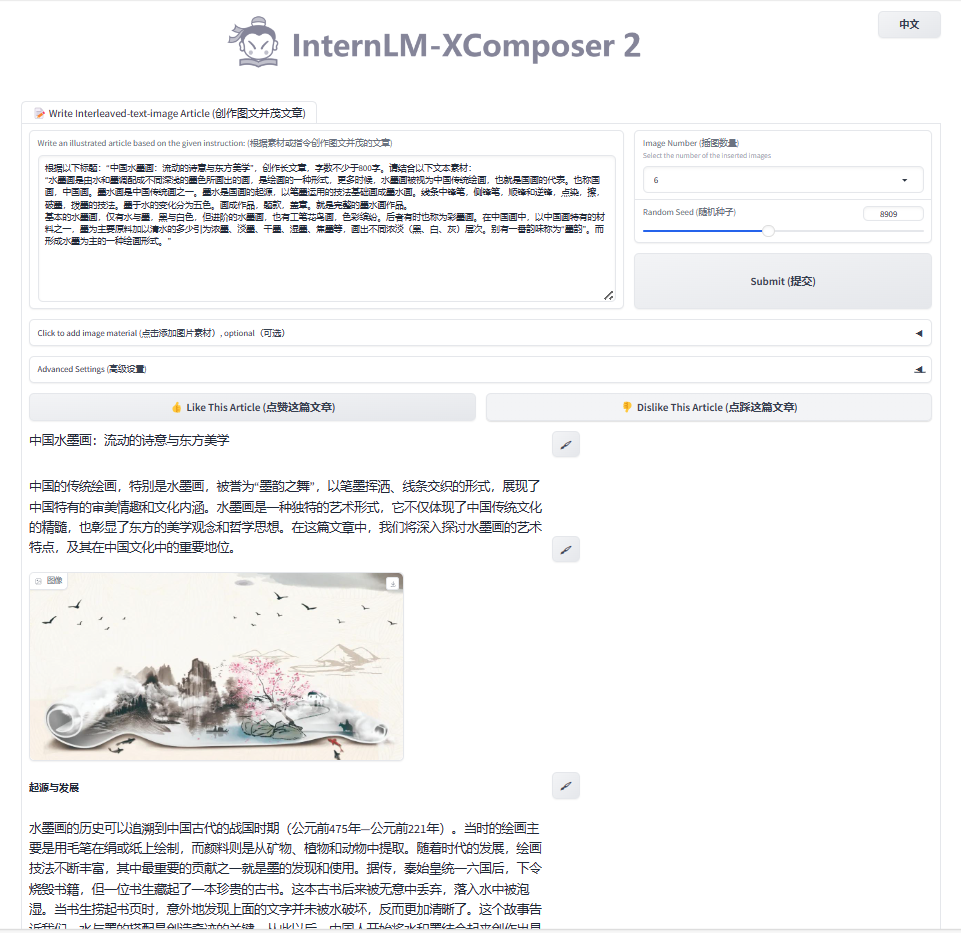

打开 http://127.0.0.1:6006 实践效果如下图所示:

点击Submit (提交),体验默认提示词生成

此时我们可以看到vscode终端里有输出的过程,感兴趣的可以看一下生成过程

5.4 图片理解实战(开启 50% A100 权限后才可开启此章节)

接下来,我们在vscode中,关闭并重新启动一个新的 terminal,继续输入指令,启动 InternLM-XComposer2-vl:

conda activate demo1

cd /root/demo/InternLM-XComposer

python /root/demo/InternLM-XComposer/examples/gradio_demo_chat.py \

--code_path /root/models/internlm-xcomposer2-vl-7b \

--private \

--num_gpus 1 \

--port 6006打开 http://127.0.0.1:6006 (上传图片后) 键入内容示例如下:

请分析一下图中内容实践效果如下图所示:

作业章节

基础作业 (结营必做)

- 使用

InternLM2-Chat-1.8B模型生成 300 字的小故事(需截图)

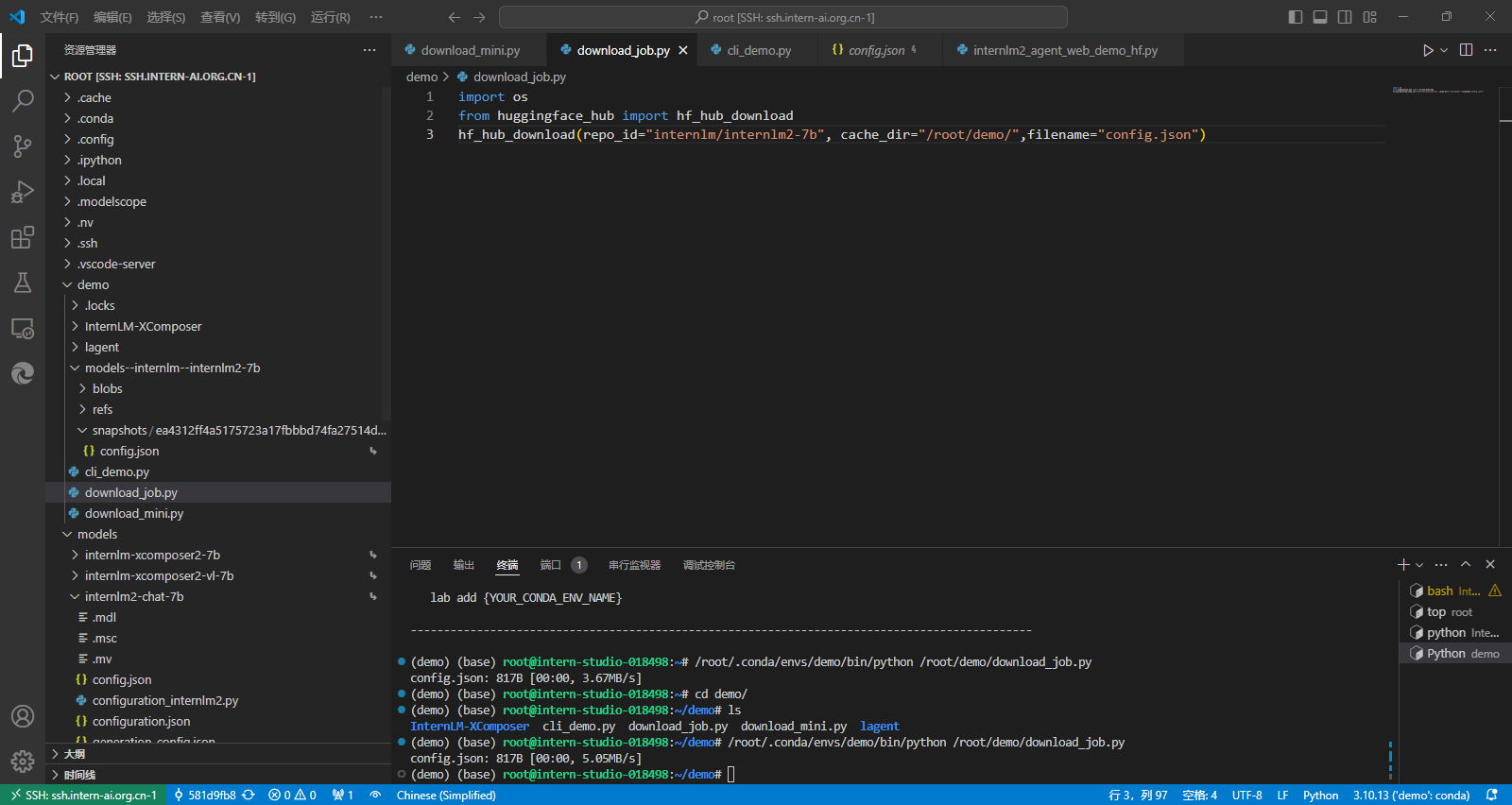

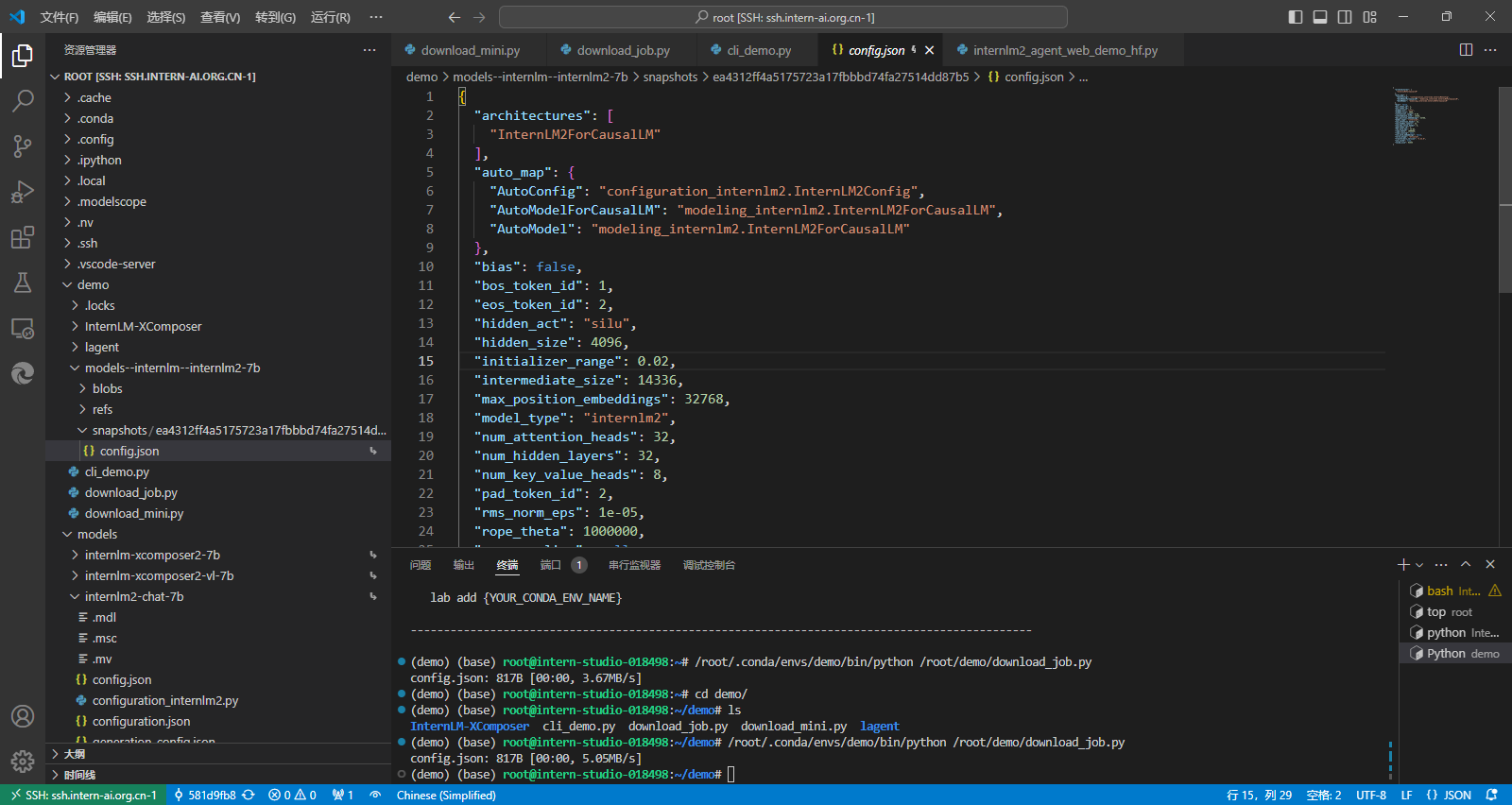

进阶作业 (优秀学员必做)

- 熟悉

huggingface下载功能,使用huggingface_hubpython 包,下载InternLM2-Chat-7B的config.json文件到本地(需截图下载过程)

import os

from huggingface_hub import hf_hub_download

hf_hub_download(repo_id="internlm/internlm2-7b",

cache_dir="/root/demo/",

filename="config.json")

- 完成

浦语·灵笔2的图文创作及视觉问答部署(需截图)

- 完成

Lagent工具调用数据分析Demo 部署(需截图)

Comments NOTHING